L’administration système manuelle n’est pas une fatalité, c’est une dette technique qui coûte cher en fiabilité et en réactivité.

- Les tâches manuelles, même simples, sont une source constante d’erreurs, de retards et de vulnérabilités de sécurité.

- L’automatisation transforme les opérations IT d’un mode réactif (« éteindre les incendies ») à une ingénierie proactive et prédictible (« construire des systèmes anti-incendie »).

Recommandation : Cessez de traiter les symptômes et attaquez-vous à la cause. Identifiez la tâche la plus répétitive et la plus chronophage de votre équipe, et faites de son automatisation la priorité absolue du prochain trimestre.

Un disque qui sature un dimanche soir, un certificat SSL qui expire un vendredi après-midi, un nouveau collaborateur qui attend ses accès depuis trois jours… Ces scénarios ne sont pas des fatalités, mais les symptômes d’une administration système restée à l’ère de l’artisanat. Chaque intervention manuelle, chaque configuration « à la main » est une micro-fissure dans la fiabilité de votre infrastructure. C’est une forme de dette technique opérationnelle : invisible au quotidien, mais dont les intérêts se paient en temps de crise, en frustration des équipes et en perte de confiance des utilisateurs. Beaucoup pensent que la solution réside dans le recrutement de plus d’adminsys pour gérer la charge. D’autres se contentent de scripter quelques tâches isolées, sans vision d’ensemble.

Mais si la véritable clé n’était pas de faire plus, mais de construire différemment ? Si le but n’était plus de « gérer » des serveurs, mais d' »ingénierer » des services ? C’est le changement de paradigme fondamental que propose l’automatisation IT. Il ne s’agit pas simplement d’adopter de nouveaux outils, mais de passer d’une posture d’artisan réactif à celle d’un ingénieur de la fiabilité (SRE), où chaque processus est conçu pour être reproductible, auditable et autonome. L’objectif de cet article n’est pas de lister des scripts, mais de fournir une feuille de route stratégique pour transformer votre gestion d’infrastructure, en passant des opérations manuelles à faible valeur à une véritable ingénierie de systèmes fiables.

Cet article détaille les piliers de cette transformation. À travers des cas d’usage concrets, nous verrons comment l’automatisation répond à des problématiques précises, de la gestion de workflows complexes à la sécurisation des déploiements, pour finalement aboutir à une nouvelle culture de la performance IT.

Sommaire : De l’artisanat à l’ingénierie : votre feuille de route pour l’automatisation IT

- Orchestrateurs (Control-M, Airflow) : comment piloter des chaînes de traitements complexes ?

- Provisioning de comptes : comment créer un utilisateur AD, mail et applicatif en 1 clic ?

- Maintenance préventive : comment scripter le nettoyage des logs pour éviter la saturation disque ?

- Renouvellement automatique : comment utiliser ACME et Let’s Encrypt pour ne plus gérer les certificats SSL ?

- Reporting d’infrastructure : comment générer et envoyer l’état de santé du parc chaque matin ?

- WSUS et outils tiers : comment pousser les mises à jour sans interrompre le travail des utilisateurs ?

- Terraform et Ansible : pourquoi ne plus jamais configurer un serveur à la main ?

- DevOps vs Silos traditionnels : comment briser le mur entre les développeurs et les ops ?

Orchestrateurs (Control-M, Airflow) : comment piloter des chaînes de traitements complexes ?

L’administration artisanale gère les tâches une par une. L’ingénierie fiable pilote des systèmes de tâches interconnectées. La première étape vers cette maturité est l’orchestration. Un orchestrateur, tel que le vétéran Control-M ou le plus moderne Apache Airflow, ne se contente pas d’exécuter des scripts à heures fixes comme le ferait un simple `cron`. Il gère des chaînes de traitements complexes, où le lancement d’une tâche dépend du succès (ou de l’échec) d’une ou plusieurs autres. Il permet de visualiser, de contrôler et de rejouer des workflows qui traversent plusieurs systèmes : un job ETL qui charge des données, un script qui génère un rapport, puis une notification qui envoie ce rapport par email.

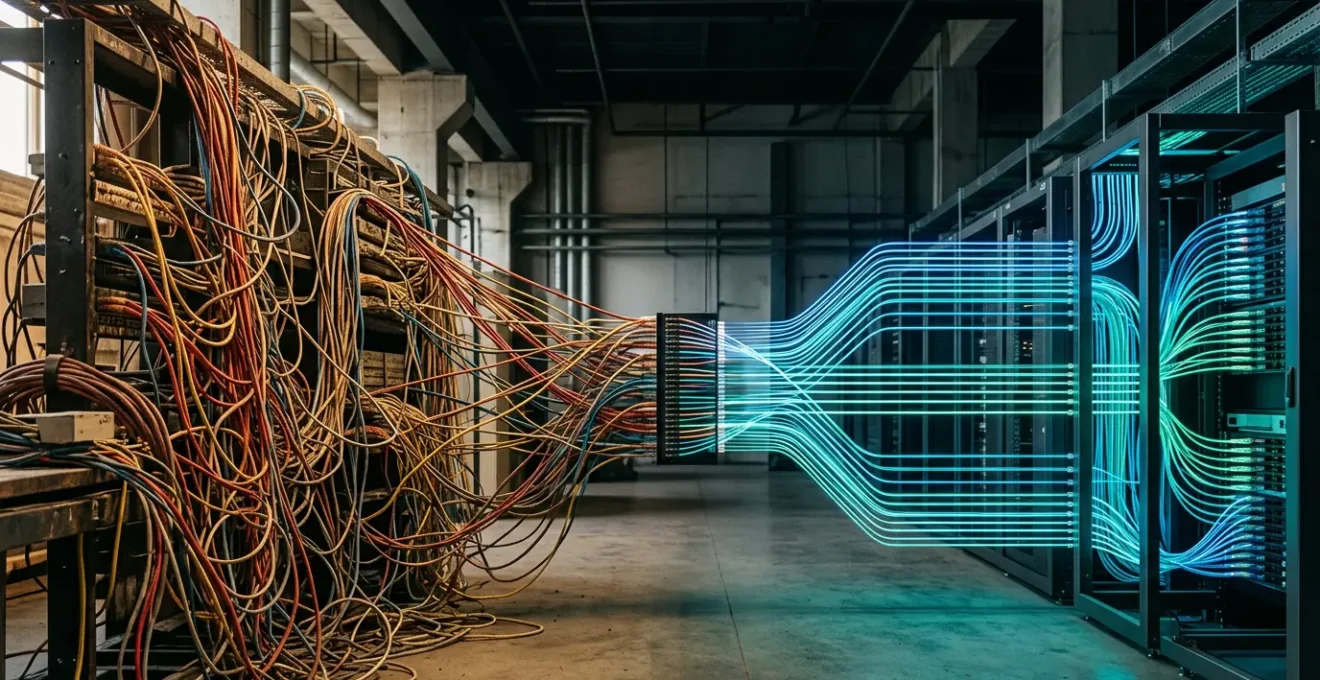

La puissance d’un orchestrateur réside dans sa capacité à modéliser ces dépendances sous forme de Graphes Orientés Acycliques (DAG). Cette représentation visuelle transforme une série de scripts obscurs en un processus métier clair et auditable. L’adoption massive de solutions comme Airflow par des centaines d’entreprises mondiales, dont AirBnb, Paypal ou Tesla, n’est pas un hasard. Elle répond à un besoin critique : maîtriser la complexité croissante des opérations IT et garantir la cohérence des traitements de bout en bout.

Cette visualisation conceptuelle illustre comment des tâches (sphères) sont connectées par des flux de données (tubes), créant un workflow orchestré. Chaque élément dépend des autres, formant une chaîne logique que l’orchestrateur pilote. Mettre en place un tel système, c’est passer du rôle de machiniste qui actionne les leviers un par un à celui de chef d’orchestre qui dirige la symphonie des données de l’entreprise. C’est la première étape pour cesser de subir les événements et commencer à les concevoir.

Provisioning de comptes : comment créer un utilisateur AD, mail et applicatif en 1 clic ?

L’arrivée d’un nouveau collaborateur est un processus critique. Pourtant, dans de nombreuses organisations, il se transforme en une série de tickets et de tâches manuelles : créer le compte Active Directory, puis la boîte mail, puis les accès aux applications métiers, aux partages réseau… Chaque étape est une source potentielle d’erreur, de retard et de faille de sécurité. L’automatisation du provisioning de comptes n’est pas un luxe, c’est une nécessité pour garantir efficacité, conformité et sécurité. L’objectif est simple : le manager des ressources humaines remplit un formulaire, et un workflow automatisé se charge de provisionner l’ensemble des droits et accès nécessaires, en une seule opération fiable et tracée.

Cette approche, souvent portée par des solutions de gestion des identités et des accès (IAM), transforme radicalement le rôle de l’équipe IT. Comme le souligne une analyse de ManageEngine, l’automatisation du provisioning et du de-provisioning élimine les tâches répétitives, permettant aux équipes de se concentrer sur des projets à plus forte valeur. Le « de-provisioning », la révocation automatique de tous les accès lors du départ d’un employé, est tout aussi crucial : il élimine le risque des « comptes fantômes », une vulnérabilité majeure.

Étude de Cas : Industrialisation des onboardings avec Youzer

Une entreprise a mis en place la solution IAM Youzer pour rationaliser le processus d’intégration de ses nouveaux employés. En centralisant et en normant la création des comptes, le projet a permis de réduire drastiquement les erreurs manuelles et les délais d’attente. Selon le Responsable des Systèmes d’Information, cette automatisation a non seulement fiabilisé le processus, mais a également libéré un temps considérable pour l’équipe IT, qui peut désormais se consacrer à des initiatives stratégiques plutôt qu’à des tâches administratives répétitives.

En industrialisant l’onboarding et l’offboarding, on ne gagne pas seulement du temps. On met en place un processus systématique et auditable qui renforce la posture de sécurité globale de l’entreprise. Chaque compte est créé selon les mêmes règles, chaque départ entraîne une coupure nette des accès. C’est l’ingénierie appliquée à la gestion du capital humain.

Maintenance préventive : comment scripter le nettoyage des logs pour éviter la saturation disque ?

L’alerte « Disk full » qui arrive à 3h du matin est un grand classique de l’administration système artisanale. La cause ? Très souvent, une accumulation de fichiers de logs qui n’ont jamais été purgés. La réaction « artisanale » est de se connecter en urgence, supprimer manuellement les fichiers les plus anciens et espérer que cela tienne jusqu’au matin. L’approche « ingénierie » est de concevoir un système où cette situation ne peut tout simplement pas se produire. Cela passe par une stratégie de gestion des logs automatisée, qui inclut la rotation, l’archivage et la centralisation.

La rotation des logs (via des outils comme `logrotate` sur Linux) est la première étape : créer un nouveau fichier de log chaque jour ou lorsque le fichier atteint une certaine taille, et conserver les N dernières versions. La deuxième étape est l’archivage : compresser automatiquement les anciens logs et les déplacer vers un stockage moins coûteux. Mais la véritable maturité est atteinte avec la centralisation des logs. Plutôt que de laisser les logs sur chaque serveur, ils sont envoyés en temps réel vers un système centralisé. Des solutions comme la suite Elastic (ELK Stack) se sont imposées comme un standard pour cette tâche. La suite Elastic est l’une des solutions les plus populaires pour collecter, analyser et visualiser des volumes massifs de logs.

Centraliser les logs a un double avantage. D’une part, cela évite la saturation des disques sur les serveurs de production. D’autre part, cela offre une vue consolidée et puissante pour le diagnostic. Au lieu de se connecter sur dix serveurs pour trouver une erreur, l’équipe peut interroger une seule interface pour corréler des événements sur l’ensemble de l’infrastructure. Un script de nettoyage n’est donc plus une rustine, mais une composante d’une stratégie globale de visibilité et de maintenance préventive.

Renouvellement automatique : comment utiliser ACME et Let’s Encrypt pour ne plus gérer les certificats SSL ?

La gestion des certificats SSL/TLS est le parfait exemple d’une tâche manuelle à faible valeur ajoutée, mais à haut risque. Oublier de renouveler un certificat peut rendre un site web ou un service entier indisponible, avec un impact direct sur l’image et le chiffre d’affaires. L’approche artisanale consiste à maintenir un tableur de dates d’expiration et à lancer manuellement le processus de renouvellement quelques semaines avant l’échéance. C’est une charge mentale constante et une source d’erreurs humaines inévitables.

L’arrivée de Let’s Encrypt et du protocole ACME (Automated Certificate Management Environment) a complètement changé la donne. ACME est un protocole standard qui permet à un agent logiciel sur votre serveur de prouver automatiquement son contrôle sur un nom de domaine et de demander, obtenir et installer un certificat SSL/TLS sans aucune intervention humaine. Le renouvellement, qui se fait typiquement tous les 90 jours, est lui aussi entièrement automatisé. Le succès de cette approche est phénoménal : en octobre 2022, près de 240 millions de certificats actifs étaient déployés via Let’s Encrypt sur Internet.

Mettre en place l’automatisation avec ACME, c’est décider une fois pour toutes que la gestion des certificats n’est plus un sujet. Cela réduit la surface d’attaque manuelle et libère l’équipe IT d’une tâche récurrente et anxiogène. Des outils comme `certbot` rendent ce processus extrêmement simple à configurer sur la plupart des serveurs web. Plutôt que de payer pour des certificats et pour le temps humain nécessaire à leur gestion, l’automatisation offre un niveau de sécurité équivalent, voire supérieur, pour un coût et un effort quasi nuls après la configuration initiale. C’est l’efficience à l’état pur.

Reporting d’infrastructure : comment générer et envoyer l’état de santé du parc chaque matin ?

Dans un environnement complexe, savoir « ce qui se passe » est un défi permanent. Le reporting manuel, souvent un copier-coller de données depuis différentes consoles dans un email, est chronophage, sujet aux erreurs et rapidement obsolète. L’ingénierie fiable exige un reporting automatisé, qui fournit chaque matin une vision claire et synthétique de l’état de santé de l’infrastructure. Il ne s’agit pas de noyer le management sous des gigaoctets de logs, mais de présenter des indicateurs de performance clés (KPIs) pertinents et actionnables.

Un script ou un workflow automatisé peut se connecter aux différentes API de vos systèmes (monitoring, virtualisation, cloud, sécurité) pour collecter des métriques essentielles : utilisation CPU/RAM/Disque, état des sauvegardes de la veille, nombre de tentatives de connexion échouées, statut des services critiques, etc. Ces données sont ensuite agrégées, mises en forme dans un tableau de bord HTML concis ou un PDF, et envoyées par email aux parties prenantes. Ce rapport matinal devient un rituel qui instaure une culture de la transparence et de la proactivité. Au lieu de découvrir un problème par un appel d’un utilisateur, on le détecte à 8h05 dans le rapport de santé.

Pour aller plus loin, l’automatisation du reporting permet de suivre des métriques avancées, comme les métriques DORA (DevOps Research and Assessment), qui mesurent l’efficience des processus de développement et de déploiement. Suivre ces indicateurs permet de quantifier l’impact des efforts d’automatisation et de piloter l’amélioration continue sur la base de données factuelles, et non d’intuitions. Le reporting n’est plus une corvée, il devient un outil stratégique de pilotage.

Votre plan d’action pour mesurer la performance DevOps : les métriques DORA

- Fréquence de Déploiement (Deployment Frequency) : Mesurez à quelle fréquence vous réussissez à pousser du code en production. L’objectif est d’augmenter cette fréquence pour livrer de la valeur plus rapidement.

- Délai de Livraison (Lead Time for Changes) : Chronométrez le temps entre le commit d’un code et son déploiement effectif. Travaillez à réduire ce délai pour accélérer votre cycle de développement.

- Taux d’Échec des Changements (Change Failure Rate) : Calculez le pourcentage de déploiements qui provoquent une dégradation de service et nécessitent une remédiation. Visez à diminuer ce taux pour améliorer la fiabilité.

- Temps Moyen de Restauration (Time to Restore Service) : Quand un incident survient, mesurez le temps nécessaire pour restaurer le service. Un MTTR (Mean Time To Restore) bas est le signe d’une forte résilience.

WSUS et outils tiers : comment pousser les mises à jour sans interrompre le travail des utilisateurs ?

La gestion des mises à jour (patch management) est un dilemme permanent pour les équipes IT. D’un côté, il est impératif d’appliquer les correctifs de sécurité pour se protéger des vulnérabilités. De l’autre, chaque mise à jour est une interruption potentielle pour l’utilisateur, avec des redémarrages forcés et des baisses de performance. L’approche « artisanale » consiste à approuver les mises à jour et à laisser les postes les installer quand ils le peuvent, créant un parc hétérogène et difficile à sécuriser. Une approche plus directive mais brutale est de forcer les installations et les redémarrages, au grand dam des utilisateurs.

L’ingénierie fiable recherche un équilibre : assurer un déploiement rapide et complet des patchs tout en minimisant l’impact sur la productivité. Des outils comme WSUS (Windows Server Update Services) permettent de centraliser l’approbation et la distribution des mises à jour Microsoft. Mais leur véritable puissance se révèle lorsqu’ils sont couplés à des outils de gestion de parc (comme Microsoft Endpoint Configuration Manager ou des solutions tierces) qui permettent une granularité fine dans le déploiement. On peut alors définir des « fenêtres de maintenance » en dehors des heures de travail, cibler des groupes de pilotes pour tester les mises à jour avant un déploiement général, et surtout, communiquer de manière proactive avec les utilisateurs pour leur permettre de lancer le redémarrage au moment qui leur convient le mieux.

L’automatisation réduit le temps de déploiement des logiciels afin que les équipes puissent livrer les mises à jour plus fréquemment. Les déploiements automatisés sont cohérents, reproductibles et standardisés.

– Atlassian, Guide Automatisation des déploiements

Cette citation résume parfaitement l’objectif. L’automatisation du patching ne vise pas seulement à cliquer sur « approuver ». Elle vise à construire un pipeline de déploiement fiable et prédictible pour les mises à jour, qui transforme une corvée redoutée en un processus d’hygiène informatique régulier et transparent pour l’utilisateur final.

À retenir

- L’automatisation n’est pas un coût, c’est un investissement stratégique qui transforme la dette technique opérationnelle en fiabilité.

- Commencez par des gains rapides à fort impact : le provisioning des comptes, la gestion des logs et le renouvellement des certificats.

- L’Infrastructure as Code (IaC) est le but ultime : ne plus gérer des serveurs, mais du code qui les définit, les rendant parfaitement reproductibles.

Terraform et Ansible : pourquoi ne plus jamais configurer un serveur à la main ?

Configurer un serveur manuellement, c’est comme construire une voiture à la main : c’est long, sujet aux erreurs, et chaque voiture sera légèrement différente de la précédente. C’est l’essence même de l’artisanat. L’approche d’ingénierie moderne est l’Infrastructure as Code (IaC). Le principe est simple : l’ensemble de votre infrastructure (serveurs, réseaux, bases de données, load balancers) est défini dans des fichiers de code, comme le serait une application. Ce code est versionné, testé et peut être exécuté pour créer, modifier ou détruire votre infrastructure de manière entièrement automatisée.

Des outils comme Terraform et Ansible sont les piliers de cette révolution. Bien qu’ils soient souvent utilisés ensemble, ils ont des rôles distincts. Terraform excelle dans le provisioning : il est expert pour créer l’infrastructure brute (une machine virtuelle sur AWS, un réseau dans Azure). Ansible excelle dans la configuration : une fois le serveur créé, il s’assure qu’il est dans l’état désiré (le bon logiciel installé, les bons services démarrés, la bonne configuration appliquée). En combinant les deux, on obtient un pipeline qui peut déployer une infrastructure complète et prête à l’emploi à partir de zéro, en quelques minutes. L’approche IaC réduit les erreurs et augmente l’efficacité en éliminant les interventions manuelles.

L’avantage le plus important de l’IaC est la reproductibilité et l’élimination du « configuration drift », ce phénomène où les serveurs, initialement identiques, dérivent lentement vers des états de configuration différents suite à des interventions manuelles. Avec l’IaC, le code est la seule source de vérité. Pour changer quelque chose, on modifie le code, on le valide, et on l’applique. L’infrastructure devient prédictible, auditable et jetable. Un serveur ne fonctionne plus ? On ne le dépanne pas pendant des heures, on le détruit et on en recrée un identique en trois minutes. C’est le passage ultime de l’artisanat, où l’on chérit chaque pièce unique, à l’ingénierie, où l’on garantit la perfection par la standardisation.

DevOps vs Silos traditionnels : comment briser le mur entre les développeurs et les ops ?

Toutes les automatisations techniques que nous avons vues ne sont que des outils. Leur plein potentiel ne peut être atteint que si elles s’inscrivent dans une transformation culturelle plus profonde : la transition des silos traditionnels vers une culture DevOps. Historiquement, le monde de l’IT est séparé par un « mur » : d’un côté, les développeurs (Dev), dont le but est de produire de nouvelles fonctionnalités rapidement. De l’autre, les opérationnels (Ops), dont le but est de maintenir la stabilité et la fiabilité de la production. Leurs objectifs sont souvent contradictoires, ce qui génère friction, lenteur et méfiance.

Le DevOps n’est pas un métier, c’est une philosophie et un ensemble de pratiques qui visent à abattre ce mur. Il s’agit d’intégrer les équipes de développement et d’opérations pour qu’elles travaillent ensemble tout au long du cycle de vie d’une application, de la conception au déploiement et à la maintenance. L’automatisation est le ciment de cette collaboration. Des pipelines de CI/CD (Continuous Integration/Continuous Deployment) automatisés permettent aux développeurs de livrer du code qui est automatiquement testé, packagé et déployé en production de manière fiable, en utilisant les standards définis par les Ops.

Cette image illustre la fusion des compétences : les mains du développeur sur le code et celles de l’opérationnel sur l’infrastructure travaillent sur un projet commun. Le rôle de l’admin sys ne disparaît pas, il évolue. Il devient un ingénieur de la fiabilité qui ne gère plus des serveurs, mais construit les plateformes et les outils d’automatisation qui permettent aux développeurs de déployer leurs applications de manière autonome et sécurisée. Briser le mur, ce n’est pas fusionner les équipes sur un organigramme, c’est leur donner des objectifs et des outils communs pour livrer de la valeur plus vite et de manière plus fiable.

Évaluez dès maintenant les solutions d’automatisation les plus adaptées à vos processus pour commencer à transformer votre administration système en une véritable ingénierie de la fiabilité.