Pour un CTO, le débat « scale-up vs scale-out » est obsolète ; la survie à un pic de trafic comme le Black Friday repose sur une architecture composite qui orchestre des lignes de défense successives.

- Votre première ligne de défense n’est pas vos serveurs, mais une stratégie de cache agressive (Varnish, Redis) visant plus de 80% de hit-ratio.

- Le scale-out via des orchestrateurs comme Kubernetes est la norme pour les services stateless, mais il ne peut compenser une base de données monolithique lente.

Recommandation : Cessez de penser en termes de choix binaire. Cartographiez vos services, définissez une stratégie de scalabilité pour chaque couche (cache, applicatif, données) et testez leurs points de rupture de manière obsessionnelle.

Le compte à rebours avant le Black Friday est lancé. Pour un directeur technique, cette période rime moins avec promotions qu’avec une angoisse sourde : celle de l’écran blanc, du message « 503 Service Unavailable » qui s’affiche en plein pic de commandes. La réputation de l’entreprise, et des millions d’euros de chiffre d’affaires, reposent sur la capacité de l’infrastructure à tenir la charge. Face à ce défi, le débat semble souvent se résumer à une question binaire : faut-il opter pour la scalabilité verticale (scale-up) en achetant un serveur plus puissant, ou pour la scalabilité horizontale (scale-out) en multipliant le nombre de serveurs ?

Cette opposition, bien que pédagogique, est un piège. Les architectures modernes qui survivent et prospèrent lors de ces événements extrêmes ne choisissent pas l’un ou l’autre. Elles les composent. La véritable question n’est pas « vertical ou horizontal ? », mais « comment construire une architecture composite où chaque couche joue un rôle de ligne de défense pour absorber une part de la charge ? ». La résilience ne naît pas d’une solution unique, mais d’une orchestration intelligente de plusieurs stratégies de scalabilité, du répartiteur de charge jusqu’au plus profond de la base de données.

Cet article n’est pas un manuel théorique. C’est une feuille de route stratégique pour les CTO qui doivent construire cette résilience. Nous allons décomposer, couche par couche, les éléments d’une architecture capable d’encaisser les assauts du plus grand événement e-commerce de l’année, en passant de la répartition de charge à la conteneurisation, jusqu’aux stratégies de cloud hybride.

Pour naviguer au cœur de cette architecture de haute performance, voici les différentes strates que nous allons explorer.

Sommaire : Concevoir une architecture résiliente pour les pics de charge extrêmes

- Load Balancing : comment répartir 10 000 utilisateurs simultanés sur 50 serveurs web ?

- Limites du Scale-up : pourquoi acheter un plus gros serveur finit toujours par coûter trop cher ?

- Redis et Varnish : comment servir 90% des requêtes sans taper dans la base de données ?

- Sharding : comment découper votre base de données géante en morceaux gérables ?

- Tir de performance : comment simuler 100 000 utilisateurs pour voir ce qui casse en premier ?

- Docker et Kubernetes : pourquoi ces technologies sont devenues le standard de déploiement ?

- Cloud Bursting : comment utiliser le cloud uniquement lors des pics de charge imprévus ?

- Cloud Hybride : comment garder vos données sensibles en interne tout en profitant de la puissance du cloud public ?

Load Balancing : comment répartir 10 000 utilisateurs simultanés sur 50 serveurs web ?

Le répartiteur de charge est le chef d’orchestre de votre infrastructure. C’est la première ligne de défense, celle qui accueille chaque requête et la dirige intelligemment vers un serveur disponible. Son rôle n’est pas seulement de distribuer le trafic pour éviter la surcharge d’un serveur unique, mais aussi de garantir une expérience utilisateur sans couture. Face à un pic de trafic, un site qui plante est la pire des issues. Une étude montre d’ailleurs que 84% des consommateurs préfèrent une file d’attente en ligne à un site inaccessible. Le load balancer est la technologie qui permet d’éviter ce crash en répartissant l’effort.

Cependant, pour un site e-commerce, une simple répartition cyclique (Round Robin) est une recette pour le désastre. Imaginez un client qui ajoute un produit à son panier sur le serveur A, puis sa requête suivante pour finaliser la commande est envoyée au serveur B, où son panier est vide. C’est une vente perdue. Pour contrer cela, des mécanismes de persistance de session (ou « sticky sessions ») sont indispensables. La méthode IP Hash, par exemple, garantit qu’un utilisateur est toujours redirigé vers le même serveur en se basant sur son adresse IP, préservant ainsi l’intégrité de sa session et de son panier d’achat.

Le load balancer est donc bien plus qu’un simple aiguilleur. C’est un garant de la cohérence de l’expérience utilisateur sous haute tension. Mais il ne peut faire de miracles : si les serveurs en aval sont lents ou saturés, il ne fera que répartir la lenteur. Il est la condition nécessaire, mais non suffisante, à la scalabilité.

Limites du Scale-up : pourquoi acheter un plus gros serveur finit toujours par coûter trop cher ?

Face à un besoin de performance, la première impulsion est souvent le scale-up : augmenter la puissance de la machine existante. Ajouter de la RAM, un CPU plus rapide, des disques plus véloces. Cette approche a l’avantage de la simplicité. Il n’y a pas, ou peu, de modification à apporter à l’architecture logicielle. C’est une stratégie légitime pour démarrer ou pour gérer une croissance modérée. Comme le formule un visionnaire du secteur, il y a une place pour cette approche dans toute stratégie.

Il n’y a pas de remplacement pour le scale-up avant le scale-out.

– Jensen Huang, Vision stratégique pour les infrastructures IA

Cependant, cette stratégie rencontre rapidement deux murs : le mur physique et le mur financier. Les lois de la physique imposent une limite à la puissance d’une seule machine. Au-delà d’un certain point, le gain de performance marginal décroît tandis que le coût explose de manière exponentielle. Comme le montrent certaines analyses, un serveur monolithique de très haute performance peut coûter jusqu’à 186 700 $. Ce coût prohibitif rend la stratégie insoutenable pour financer la capacité nécessaire à un pic de type Black Friday qui ne dure que quelques jours.

Pire encore, la scalabilité verticale crée un Single Point of Failure (SPOF). Si ce super-serveur tombe en panne, l’intégralité de votre service s’effondre. Il n’y a pas de filet de sécurité. Le scale-up est donc une étape, un outil pour optimiser une brique de l’architecture, mais il ne peut en aucun cas constituer la stratégie globale pour une plateforme à haute disponibilité.

Redis et Varnish : comment servir 90% des requêtes sans taper dans la base de données ?

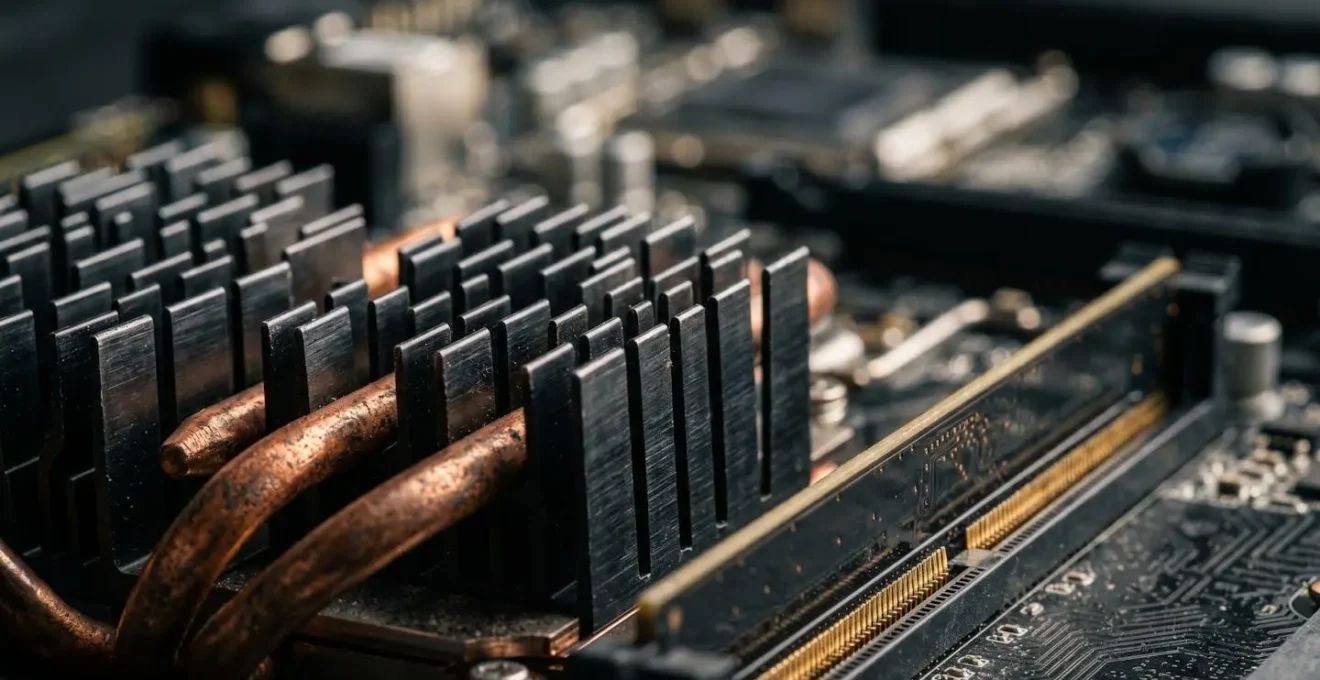

Si le load balancer est la première ligne de défense, la stratégie de cache est la seconde, et sans doute la plus critique. L’objectif est simple : répondre à un maximum de requêtes sans jamais solliciter les couches les plus lentes et coûteuses de l’architecture, à savoir l’applicatif et la base de données. C’est ici qu’intervient le duo Varnish et Redis, deux outils aux rôles complémentaires.

Varnish agit comme un reverse proxy cache HTTP. Placé devant les serveurs web, il met en mémoire des pages entières déjà générées. Pour un visiteur non connecté naviguant sur des pages produits ou des catégories, Varnish peut servir la page en quelques millisecondes, sans même que la requête n’atteigne votre application. C’est une arme redoutable pour absorber le trafic des curieux et des lèche-vitrines.

Redis, quant à lui, est un système de cache in-memory qui opère au niveau de l’application. Il ne stocke pas des pages HTML, mais des objets, des résultats de requêtes de base de données complexes, ou des données de session utilisateur. Quand votre application a besoin d’afficher les informations d’un utilisateur connecté ou le résultat d’un calcul coûteux, elle vérifie d’abord dans Redis. Si la donnée y est, la base de données est épargnée. Atteindre un cache hit ratio (le pourcentage de requêtes servies par le cache) élevé est un indicateur de performance clé. Selon les meilleures pratiques, viser un cache hit ratio de 80% ou plus est un objectif réaliste et transformateur pour la performance. Cela signifie que 8 requêtes sur 10 n’atteignent jamais votre base de données, la protégeant ainsi de l’implosion.

Sharding : comment découper votre base de données géante en morceaux gérables ?

Même avec la meilleure stratégie de cache du monde, il y aura toujours des requêtes qui devront atteindre la base de données : l’enregistrement d’une nouvelle commande, la création d’un compte client, la mise à jour d’un stock. Lorsque le volume d’écriture devient si important qu’un unique serveur de base de données (même après un scale-up maximal) ne peut plus suivre, une technique radicale s’impose : le sharding.

Le sharding, ou partitionnement horizontal, consiste à découper une base de données monolithique en plusieurs petites bases de données plus petites et plus rapides, appelées « shards ». Par exemple, on peut décider de stocker les clients dont le nom commence par A-M sur un shard, et ceux de N-Z sur un autre. Cette distribution de la donnée permet de distribuer également la charge d’écriture et de lecture. C’est la traduction du principe de scale-out au niveau de la couche de persistance.

Cependant, le sharding est une des opérations les plus complexes et risquées en architecture logicielle. Il introduit une complexité immense : comment faire des requêtes qui agrègent des données sur plusieurs shards ? Comment maintenir la cohérence ? Comment rééquilibrer les shards si l’un d’eux grossit plus vite que les autres ? C’est une modification qui impacte en profondeur le code applicatif.

Si il n’est pas possible de sharder facilement vos données, alors vous ne pouvez pas scaler horizontalement sans modifier en profondeur votre applicatif.

Le sharding n’est pas une décision à prendre à la légère. C’est souvent l’arme du dernier recours, à n’envisager qu’une fois que toutes les autres options d’optimisation (réplication en lecture, indexation, optimisation des requêtes) ont été épuisées. C’est une solution puissante, mais qui signe un pacte de complexité à long terme avec votre infrastructure.

Tir de performance : comment simuler 100 000 utilisateurs pour voir ce qui casse en premier ?

Une architecture, aussi brillante soit-elle sur le papier, n’a de valeur que si elle est éprouvée par la réalité. Attendre le jour du Black Friday pour découvrir ses faiblesses est un suicide professionnel. Les tirs de performance, ou tests de charge, sont la seule manière de valider une stratégie de scalabilité. L’objectif n’est pas de vérifier « si ça marche », mais de répondre à une question bien plus précise : « où est le prochain point de rupture ? ». Avec un trafic qui peut doubler par rapport à une journée normale, les faiblesses se cachent souvent dans des endroits inattendus.

Un tir de performance réaliste ne se contente pas de bombarder la page d’accueil. Il simule des parcours utilisateurs complexes : recherche de produits, ajout au panier, processus de paiement, connexion à l’espace client. Des outils comme k6, Gatling ou JMeter permettent de scripter ces scénarios et de les jouer à très grande échelle, simulant des dizaines de milliers d’utilisateurs simultanés. Pendant ce temps, un monitoring fin de toutes les couches de l’infrastructure (CPU, RAM, connexions à la base de données, latence réseau, temps de réponse des API) est essentiel.

Le résultat de ces tests est une cartographie des goulots d’étranglement. Est-ce le nombre de connexions à la base de données qui sature ? La limite de workers de votre serveur applicatif ? Une API tierce de paiement qui ne répond plus ? Chaque test permet d’identifier un point de rupture, de le corriger, puis de relancer un test pour découvrir le suivant, dans une démarche itérative jusqu’à ce que l’architecture tienne la charge cible avec une marge de sécurité.

Checklist d’audit : valider votre architecture pour les pics de charge

- Points de contact : lister tous les endpoints API et pages critiques du parcours client (ex: `POST /cart`, `GET /product/:id`, `POST /checkout`).

- Collecte : inventorier les métriques de performance de base en charge normale (temps de réponse P95, utilisation CPU/RAM, IOPS disque).

- Cohérence : confronter les limites de chaque service (max connexions DB, bande passante CDN, limites de rate-limiting des API tierces) aux objectifs de trafic.

- Mémorabilité/émotion : repérer les dépendances cachées et les points de rupture non évidents (ex: un microservice de facturation, une API de géolocalisation).

- Plan d’intégration : définir un plan de remédiation priorisé pour chaque goulot d’étranglement identifié (ex: P1: augmenter le pool de connexions DB, P2: optimiser une requête SQL lente, P3: mettre en cache un endpoint).

Docker et Kubernetes : pourquoi ces technologies sont devenues le standard de déploiement ?

La scalabilité horizontale, c’est-à-dire l’ajout de serveurs pour distribuer la charge, pose un défi opérationnel majeur : comment déployer et gérer une application de manière cohérente sur des dizaines, voire des centaines de machines ? C’est ici que l’écosystème de la conteneurisation, mené par Docker et Kubernetes, a révolutionné la donne. Il est devenu le socle technique de l’architecture composite.

Docker permet d’empaqueter une application et toutes ses dépendances dans une image portable et isolée : le conteneur. « Ça marche sur ma machine » devient enfin « ça marche partout », car le conteneur s’exécute de la même manière sur le poste d’un développeur ou sur un serveur de production. Cette standardisation élimine une source majeure de problèmes lors des déploiements.

Kubernetes (K8s) est l’orchestrateur qui prend le relais. Il gère le cycle de vie de ces conteneurs à grande échelle. Son super-pouvoir est l’autoscaling. Grâce au Horizontal Pod Autoscaler (HPA), Kubernetes peut surveiller l’utilisation du CPU ou d’autres métriques personnalisées et décider automatiquement d’augmenter ou de réduire le nombre de conteneurs exécutant une application. Si la charge monte, K8s déploie de nouvelles instances en quelques secondes. Si la charge baisse, il les supprime pour économiser les ressources. Il transforme l’élasticité en une réalité automatisée et contrôlée.

Étude de cas : réduction des coûts d’infrastructure avec l’autoscaling Kubernetes

Une entreprise SaaS a mis en œuvre l’autoscaling Kubernetes pour son service d’authentification. En se basant sur un seuil d’utilisation CPU de 70% et la profondeur de la file d’attente, le système passe automatiquement de 3 à 15 instances (pods) pendant les pics de connexion du matin. Comme le montre cette analyse sur la scalabilité, cette approche a permis de réduire les coûts d’infrastructure de 35% pendant les heures creuses tout en maintenant une disponibilité de 99,9% pendant les pics de trafic. C’est l’illustration parfaite d’une élasticité contrôlée et rentable.

Cloud Bursting : comment utiliser le cloud uniquement lors des pics de charge imprévus ?

Même avec une infrastructure on-premise robuste et de l’autoscaling, provisionner en interne la capacité maximale pour un événement comme le Black Friday revient à construire une cathédrale pour n’y tenir qu’une messe par an. C’est un non-sens économique. Le cloud bursting est une stratégie d’architecture hybride qui offre une solution élégante à ce problème : gérer la charge de base avec ses propres ressources et déborder (« burst ») sur un cloud public (AWS, Azure, GCP) uniquement lorsque la demande explose.

L’infrastructure interne est dimensionnée pour gérer 100% du trafic normal, voire 150%. Lorsque les systèmes de monitoring détectent que la charge approche de ce seuil, des règles automatisées provisionnent des serveurs supplémentaires sur le cloud public et le répartiteur de charge commence à leur envoyer une partie du trafic. La beauté de ce modèle est sa rentabilité : vous ne payez pour la capacité de pointe du cloud public qu’à la minute ou à l’heure, uniquement lorsque vous en avez besoin. Les pics de charge, qui peuvent représenter des ventes colossales, sont ainsi gérés sans investissement initial massif.

Cette approche nécessite une architecture pensée pour l’hybridité. Les applications doivent être conteneurisées pour être déployables indifféremment en interne ou sur le cloud, et la connectivité réseau entre les deux environnements doit être performante et sécurisée. C’est la matérialisation de l’élasticité contrôlée à l’échelle de l’infrastructure globale, permettant d’absorber des pics qui peuvent générer des dizaines de milliards de dollars de revenus à l’échelle mondiale, sans surprovisionner son infrastructure 365 jours par an.

À retenir

- Le scale-up est un prérequis pour optimiser chaque nœud, pas un adversaire du scale-out.

- Votre stratégie de cache (Varnish, Redis) est votre principale ligne de défense contre les crashs de base de données.

- L’élasticité n’est pas magique : elle est orchestrée par des outils comme Kubernetes et validée par des tirs de charge rigoureux.

Cloud Hybride : comment garder vos données sensibles en interne tout en profitant de la puissance du cloud public ?

L’architecture composite trouve son apogée dans le modèle du cloud hybride. Cette approche stratégique ne se contente pas de répondre à un besoin de performance ponctuel comme le cloud bursting, mais elle structure durablement le système d’information en tirant le meilleur des deux mondes : la sécurité et le contrôle d’une infrastructure privée (on-premise) et la flexibilité quasi infinie du cloud public.

Le principe est de segmenter les services en fonction de leur criticité et de leurs besoins. Les données les plus sensibles – informations clients, données de paiement, propriété intellectuelle – restent hébergées sur des serveurs internes, sous votre contrôle total, pour répondre aux exigences de conformité (RGPD, etc.) et de sécurité. En parallèle, les services moins critiques et très demandeurs en scalabilité, comme les serveurs web stateless, les API publiques ou les services de traitement d’images, sont déployés sur le cloud public. Ils bénéficient ainsi de sa puissance de calcul à la demande et de sa couverture géographique mondiale.

Ce modèle est particulièrement pertinent dans un contexte de croissance continue du e-commerce. Des marchés matures comme la France ont encore vu une augmentation de 11% des transactions en ligne lors du dernier Black Friday. Cette pression constante exige une architecture qui soit à la fois un coffre-fort pour les données et une plateforme élastique pour l’expérience client. Le cloud hybride est la réponse architecturale à cette double contrainte.

L’architecture de votre plateforme est-elle réellement prête pour votre prochain pic de croissance ? Auditer vos points de rupture et construire votre feuille de route vers une architecture composite est la première étape vers une scalabilité maîtrisée et sereine.