Contrairement à l’idée reçue, le conflit entre Dev et Ops n’est pas un problème humain mais un symptôme d’un système défaillant.

- La friction provient d’objectifs contradictoires : la vitesse pour les Devs, la stabilité pour les Ops.

- La solution n’est pas de forcer la communication, mais de construire un système d’ingénierie partagé qui aligne ces objectifs.

Recommandation : Traitez vos opérations comme un problème logiciel, en appliquant des principes d’ingénierie pour créer une culture de la responsabilité partagée, où la collaboration devient une conséquence mécanique et non un effort.

Le scénario est familier pour tout DSI. Une mise en production tourne mal. Rapidement, le « mur de la confusion » se dresse : les équipes de développement (Dev) assurent que « ça marchait sur leur machine », tandis que les équipes d’opérations (Ops) rétorquent que « l’infrastructure est stable ». Au milieu, le service est dégradé et les accusations fusent. C’est le « blame game », ce jeu stérile où chaque camp se rejette la faute, paralysant l’entreprise et minant le moral des troupes. Face à cela, les réponses classiques consistent à organiser plus de réunions, des ateliers de « team building » ou à implorer une meilleure communication.

Pourtant, ces efforts restent souvent vains. Ils traitent le symptôme – le manque de collaboration – sans s’attaquer à la racine du mal : une organisation et des processus qui placent structurellement les Devs et les Ops en opposition. Les premiers sont mesurés sur leur vitesse de livraison, les seconds sur la stabilité de la production. Des objectifs antagonistes qui ne peuvent que générer des frictions. Et si la véritable solution n’était pas de nature humaine, mais d’ingénierie ? Si la clé pour briser le mur n’était pas la bonne volonté, mais la conception d’un système partagé qui rend la collaboration inévitable et le rejet de faute obsolète ?

Cette approche, c’est le cœur de la philosophie DevOps. Il ne s’agit pas seulement d’outils, mais d’une refonte profonde des processus pour créer une chaîne de valeur logicielle unifiée, automatisée et mesurable. Cet article explore les piliers techniques et culturels de ce système, en montrant comment, étape par étape, on peut transformer des silos rivaux en une seule et même équipe d’ingénierie orientée vers un objectif commun : livrer de la valeur de manière rapide et fiable.

Pour comprendre comment démanteler ce mur brique par brique, nous allons explorer les concepts et pratiques qui forment le socle d’une transformation DevOps réussie. Cet article est structuré pour vous guider à travers les différentes étapes de cette ingénierie de la collaboration.

Sommaire : Remplacer le mur de la confusion par un pont d’ingénierie

- Intégration Continue : comment détecter les conflits de code 5 minutes après le commit ?

- Déploiement Continu : est-il raisonnable de mettre en production 10 fois par jour ?

- Docker et Kubernetes : pourquoi ces technologies sont devenues le standard de déploiement ?

- Terraform et Ansible : pourquoi ne plus jamais configurer un serveur à la main ?

- Orchestrateurs (Control-M, Airflow) : comment piloter des chaînes de traitements complexes ?

- Observabilité : pourquoi savoir « que le serveur tourne » ne suffit pas à savoir « si l’appli marche » ?

- Culture du blameless : comment analyser un incident sans chercher de coupable ?

- Automatisation IT : comment passer de l’administration système artisanale à l’ingénierie fiable ?

Intégration Continue : comment détecter les conflits de code 5 minutes après le commit ?

La première fissure dans le mur entre Dev et Ops apparaît ici. L’Intégration Continue (CI) est bien plus qu’un simple outil d’automatisation ; c’est une philosophie de feedback quasi instantané. Le principe est simple : à chaque fois qu’un développeur soumet (« commit ») une modification de code, un processus automatisé se déclenche. Ce « pipeline » compile le code, exécute une batterie de tests (unitaires, d’intégration…) et rapporte le résultat en quelques minutes. Si une modification casse quelque chose, l’équipe le sait immédiatement, avant même que le code défectueux n’ait eu le temps de polluer le travail des autres.

Cette pratique instaure une discipline collective et une responsabilité partagée de la qualité du code. Le problème n’est plus découvert des semaines plus tard par les Ops lors d’un déploiement chaotique, mais à sa source, par les Devs eux-mêmes. Le CI dépolitise le bug. Ce n’est plus une faute, mais un fait, détecté par une machine impartiale. Pour le DSI, c’est le premier pas pour sortir du cycle des accusations. La question n’est plus « qui a cassé la production ? », mais « pourquoi le pipeline de CI n’a-t-il pas intercepté ce problème ? ». On déplace le débat de la personne vers le processus.

L’adoption de cette pratique est devenue un standard de l’industrie. Il ne s’agit plus de savoir si on doit faire du CI, mais comment l’implémenter efficacement. C’est la fondation sur laquelle repose toute la collaboration future, un prérequis pour automatiser la suite de la chaîne.

Déploiement Continu : est-il raisonnable de mettre en production 10 fois par jour ?

L’idée de déployer en production plusieurs fois par jour peut sembler terrifiante pour une organisation habituée à des cycles de livraison trimestriels. Pourtant, c’est l’un des retournements de situation les plus puissants de la pensée DevOps : déployer très souvent, par petites touches, est paradoxalement moins risqué que de déployer rarement de gros blocs de changements. Chaque petit déploiement contient peu de modifications, ce qui le rend plus facile à comprendre, à tester et, en cas de problème, à corriger. C’est l’essence du Déploiement Continu (CD), l’extension logique du CI.

Cette approche, inventée dès 2009 par Timothy Fitz qui réalisait plus de 50 déploiements par jour, transforme radicalement la gestion du risque. Au lieu d’une « grande soirée de mise en production » pleine de stress et d’incertitude, le CD normalise le déploiement pour en faire un non-événement. Les équipes les plus performantes en DevOps l’ont bien compris, atteignant des fréquences de livraison et une capacité de récupération hors normes. En effet, les études montrent que les équipes pratiquant le DevOps atteignent 46 fois plus de déploiements fréquents et récupèrent 96 fois plus vite après un incident.

Pour y parvenir, des stratégies comme le déploiement « Canary » ou « Blue-Green » sont utilisées. Plutôt que de basculer 100% du trafic sur la nouvelle version, on l’expose progressivement à un petit pourcentage d’utilisateurs. Cela permet d’observer son comportement en conditions réelles et de faire un retour arrière instantané au moindre signe de problème. Le risque n’est plus binaire (tout ou rien), il est maîtrisé et granulaire.

Cette maîtrise progressive est le symbole même de la collaboration Dev-Ops. Les Devs obtiennent la vitesse de déploiement qu’ils souhaitent, et les Ops obtiennent le contrôle et la sécurité qu’ils exigent. Le mur s’effrite encore un peu plus.

Docker et Kubernetes : pourquoi ces technologies sont devenues le standard de déploiement ?

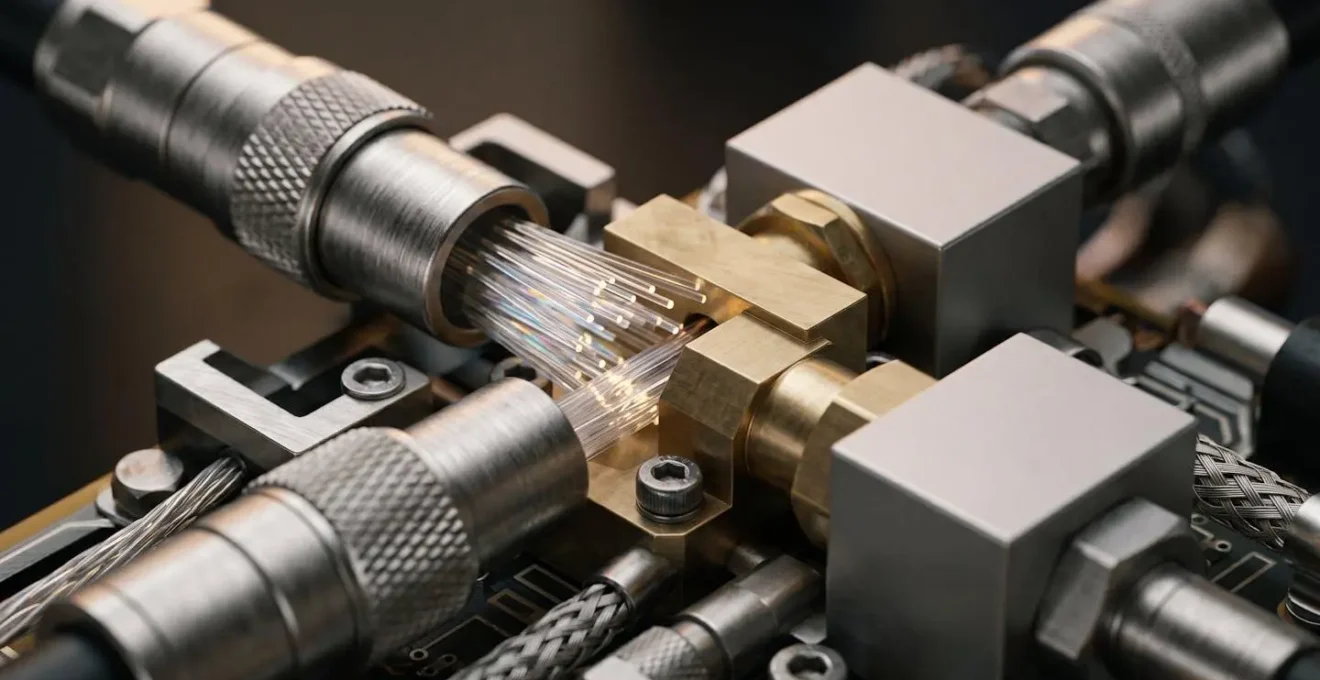

Le fameux « ça marche sur ma machine » est la source d’innombrables conflits entre Devs et Ops. Un développeur code une application qui fonctionne parfaitement dans son environnement, mais une fois déployée sur un serveur de production, elle échoue. Pourquoi ? Car les environnements sont différents : versions de librairies, configurations système, dépendances cachées… C’est là que la conteneurisation, avec Docker en figure de proue, a provoqué une révolution. Un conteneur est une « boîte » standardisée qui embarque l’application et toutes ses dépendances. Cette boîte est identique, qu’elle tourne sur le PC du développeur, sur un serveur de test ou en production.

Docker résout le problème de la portabilité. Il garantit que ce qui est testé est exactement ce qui sera exécuté, éliminant ainsi toute une catégorie de bugs liés à l’environnement. Pour la collaboration Dev-Ops, c’est un langage commun. L’artefact qui passe d’une équipe à l’autre n’est plus un vague bout de code, mais une image de conteneur, une unité de déploiement autonome, immuable et prédictible. La discussion ne porte plus sur des différences d’environnement, mais sur le comportement de cette boîte standardisée. Aujourd’hui, il est estimé que près de 65% des organisations adoptent la conteneurisation pour améliorer leurs pratiques DevOps.

Mais que faire quand on a des centaines, voire des milliers de ces conteneurs à gérer ? C’est le rôle de Kubernetes. C’est un « orchestrateur » qui automatise le déploiement, la mise à l’échelle et la gestion de ces applications conteneurisées. Il s’assure que le nombre de conteneurs requis est toujours en ligne, les redémarre en cas de crash, et répartit la charge entre eux. Kubernetes est devenu le système d’exploitation du cloud, la plateforme sur laquelle Devs et Ops peuvent construire et opérer des systèmes complexes de manière fiable et unifiée. Il offre une interface commune pour piloter l’ensemble du cycle de vie applicatif.

Terraform et Ansible : pourquoi ne plus jamais configurer un serveur à la main ?

La conteneurisation a standardisé l’application, mais qu’en est-il de l’infrastructure qui l’accueille ? Les serveurs, les réseaux, les bases de données, les pare-feux… Traditionnellement, tout cela était configuré manuellement par les Ops, via des clics dans des interfaces ou des scripts obscurs. Cette approche est lente, source d’erreurs et impossible à reproduire à l’identique. C’est la porte ouverte aux « flocons de neige » (« snowflake servers »), ces serveurs uniques dont personne ne connaît plus la configuration exacte, et que l’on n’ose plus toucher de peur de tout casser.

L’Infrastructure as Code (IaC) est la réponse à ce chaos. Le principe est de décrire et de provisionner l’ensemble de l’infrastructure informatique à travers des fichiers de code, comme on le ferait pour une application. Des outils comme Terraform permettent de décrire l’infrastructure souhaitée (ex: « je veux un réseau virtuel, 3 serveurs de type X, une base de données… »), et l’outil se charge de la créer sur le cloud provider (AWS, Azure, GCP…). D’autres outils comme Ansible se spécialisent dans la configuration de ces serveurs (installation de logiciels, gestion de fichiers…).

Le bénéfice est immense. L’infrastructure devient reproductible, testable et versionnée. Elle est stockée dans un dépôt Git, au même titre que le code applicatif. Les Devs peuvent ainsi voir et même proposer des modifications sur l’infra dont leur application dépend, tandis que les Ops gardent le contrôle en validant ces changements via des « code reviews ». Le mur devient une fenêtre, puis une porte. On ne configure plus jamais un serveur à la main, car toute dérive manuelle (« configuration drift ») est effacée au prochain déploiement automatisé. La transparence est totale.

Cette approche est un pilier de la sécurité et de la conformité, permettant d’auditer et de garantir que les bonnes pratiques sont appliquées partout, de manière systématique.

Plan d’action : auditer votre passage à l’Infrastructure as Code

- Points de contact : Listez tous les serveurs et services créés ou modifiés manuellement.

- Collecte : Inventoriez les scripts de configuration existants, les documentations (souvent obsolètes) et les connaissances implicites des équipes.

- Cohérence : Confrontez la configuration réelle des serveurs à vos standards de sécurité et de performance. Identifiez les dérives.

- Mémorabilité/émotion : Repérez les configurations « magiques » ou complexes que seule une personne maîtrise, versus celles qui sont standardisées et documentées par le code.

- Plan d’intégration : Priorisez la migration vers l’IaC en commençant par un nouveau projet ou un périmètre à faible risque pour démontrer la valeur.

Orchestrateurs (Control-M, Airflow) : comment piloter des chaînes de traitements complexes ?

À ce stade, nous avons des briques hautement automatisées : le code est testé (CI), l’application est packagée (Docker), l’infrastructure est codée (IaC) et le déploiement est fluide (CD). Mais une application moderne n’est pas un monolithe isolé. Elle interagit avec des dizaines d’autres services, dépend de traitements de données nocturnes, déclenche des flux dans d’autres systèmes… C’est un écosystème complexe de dépendances. Comment s’assurer que le traitement A se termine bien avant que B ne démarre, surtout si A est un job Big Data et B une API temps réel ? C’est le rôle des orchestrateurs.

Des outils comme Airflow, spécialisés dans les pipelines de données, ou des solutions d’entreprise comme Control-M, permettent de modéliser, planifier et superviser ces chaînes de traitements complexes. Ils agissent comme le chef d’orchestre de l’ensemble du système d’information. Le concept de « Workflow as Code », promu par des outils comme Airflow, étend la philosophie de l’IaC aux processus métier eux-mêmes. Les dépendances entre les tâches sont décrites dans un fichier de code, rendant la logique du flux de travail transparente, versionnable et collaborative. Les équipes Dev, Data et Ops peuvent ainsi collaborer sur la même logique métier dans un dépôt Git.

Cette visibilité centralisée est cruciale. En cas d’échec d’un traitement, l’orchestrateur identifie immédiatement le point de rupture et peut déclencher des alertes ou des actions correctives automatiques. Il fournit une vue de bout en bout qui transcende les silos technologiques. L’étude de cas de GitLab CI/CD pour des pipelines complexes montre des gains spectaculaires : l’intégration d’une nouvelle configuration qui prenait 5-6 heures manuellement peut être réduite à moins de 3 heures, et l’ensemble des tests d’une chaîne complexe exécuté en moins de 2 heures. C’est l’automatisation à l’échelle de l’entreprise, transformant des heures de travail manuel et de coordination en processus fiables et rapides.

Observabilité : pourquoi savoir « que le serveur tourne » ne suffit pas à savoir « si l’appli marche » ?

C’est peut-être le pilier le plus important pour détruire définitivement le mur. Le monitoring traditionnel, géré par les Ops, se concentrait sur la santé de l’infrastructure : le CPU est-il chargé ? Le disque est-il plein ? Le serveur répond-il au ping ? C’est nécessaire, mais totalement insuffisant. Une application peut être parfaitement « en panne » pour l’utilisateur (ex: impossible de valider son panier) alors que tous les indicateurs d’infrastructure sont au vert. L’observabilité, elle, part de l’expérience utilisateur pour comprendre l’état interne du système.

L’observabilité repose sur trois piliers de données : les Logs (ce qui s’est passé, un enregistrement d’événement), les Métriques (une mesure à un instant T, ex: nombre de paniers validés par seconde) et les Traces (le parcours d’une requête à travers les différents services). En combinant ces trois types de signaux, on peut poser n’importe quelle question sur le système sans avoir à prédire la panne. On passe d’un tableau de bord de voyants à un véritable outil d’investigation. Cette « vérité du terrain », accessible à la fois aux Devs et aux Ops, devient la seule source d’information fiable lors d’un incident, court-circuitant les opinions et les accusations.

C’est sur cette base que s’appuie le concept de SLI, SLO et SLA, un langage commun pour définir la fiabilité. Comme le résume parfaitement l’expert Stéphane Robert :

Un SLI (Service Level Indicator) est la métrique brute. Le SLO (Service Level Objective) est l’objectif interne. Le SLA (Service Level Agreement) est l’engagement contractuel externe. Ils forment une pyramide où chaque niveau dépend du précédent.

– Stéphane Robert, Guide SRE : SLO, SLI et Error Budgets

Le SLO (ex: « 99.9% des requêtes de connexion doivent aboutir en moins de 200ms ») devient le contrat de paix. Tant que l’objectif est tenu, les Devs peuvent continuer à déployer rapidement. S’il est menacé, les déploiements sont ralentis ou stoppés pour se concentrer sur la fiabilité. Comme le soulignent les principes SRE de Google, les SLO transforment les discussions subjectives en décisions basées sur des données. La discussion n’est plus « Devs vs Ops », mais « Comment préserver notre budget d’erreur commun ? ».

Culture du blameless : comment analyser un incident sans chercher de coupable ?

La culture du « blameless post-mortem » (analyse d’incident sans blâme) est la conséquence logique de tout ce qui précède. Elle n’est pas un vœu pieux ou une simple bienveillance, mais le résultat d’un système qui rend la recherche de coupable inutile et contre-productive. Quand un incident survient dans un environnement DevOps mature, l’équipe dispose d’une richesse d’informations sans précédent : les traces d’observabilité montrent le chemin de la requête qui a échoué, les logs donnent le contexte, les métriques montrent l’impact, et l’historique Git indique précisément quel changement de code ou d’infrastructure a été déployé juste avant.

La question n’est donc jamais « Qui a fait une erreur ? », mais « Qu’est-ce qui, dans notre système, a permis à cette erreur de se produire et d’avoir un tel impact ? ». Le focus se déplace de l’individu vers le processus. L’erreur humaine n’est pas vue comme la cause, mais comme un symptôme d’une faiblesse dans le système. Peut-être qu’un test manquait dans le pipeline de CI ? Peut-être que le déploiement progressif n’a pas été assez lent ? Peut-être qu’une alerte SLO était mal configurée ?

L’objectif du post-mortem est de comprendre la chaîne causale et de définir des actions concrètes pour renforcer le système. Chaque incident devient une opportunité d’apprentissage et d’amélioration. Cette approche a un effet psychologique puissant : elle crée un environnement de sécurité psychologique où les ingénieurs n’ont pas peur de signaler les problèmes ou de proposer des innovations audacieuses. Ils savent qu’ils ne seront pas punis pour une erreur, mais que l’organisation apprendra de celle-ci. C’est le ciment qui lie toutes les briques techniques et qui transforme un groupe d’experts en une véritable équipe d’ingénierie fiable.

À retenir

- L’automatisation du pipeline (CI/CD) n’est pas une fin en soi, mais un moyen de réduire le risque de chaque changement et d’accélérer le feedback.

- La standardisation via les conteneurs (Docker) et l’Infrastructure as Code (Terraform) élimine les frictions en créant un langage et un environnement communs.

- La culture de la collaboration se fonde sur une vérité partagée et objective : les données de l’observabilité et les Service Level Objectives (SLO).

Automatisation IT : comment passer de l’administration système artisanale à l’ingénierie fiable ?

Le voyage que nous venons de parcourir nous amène à une conclusion fondamentale. Briser le mur entre les développeurs et les opérations n’est pas une question de management ou de ressources humaines. C’est une question d’ingénierie. Il s’agit de passer d’un modèle artisanal, où des héros interviennent manuellement pour éteindre des incendies, à un modèle industriel, où la fiabilité est conçue, codée et automatisée au cœur même du système. Comme le dit l’adage fondateur de la mouvance SRE (Site Reliability Engineering) chez Google, il s’agit de « traiter les opérations comme un problème logiciel ».

Cela signifie que chaque tâche répétitive doit être automatisée. Chaque configuration doit être écrite sous forme de code. Chaque déploiement doit être un processus prédictible et sans drame. Chaque incident doit être une source de données pour améliorer le système, et non une occasion de chercher un bouc émissaire. L’automatisation n’est pas le but, mais le moyen de libérer le temps précieux des ingénieurs pour qu’ils se consacrent à des tâches à plus forte valeur ajoutée : améliorer la performance, renforcer la sécurité, et innover.

Pour le DSI, le bénéfice est double. D’une part, une amélioration drastique de la vitesse et de la fiabilité des services IT, avec un impact direct sur la satisfaction client. D’autre part, une transformation profonde de la culture interne, passant d’un climat de méfiance et de frustration à une dynamique de collaboration et d’amélioration continue. Les résultats sont là : 99% des organisations ayant implémenté DevOps rapportent des effets positifs, allant d’une meilleure qualité des produits à une plus grande satisfaction des équipes.

La transformation DevOps est un marathon, pas un sprint. Mais en abordant la collaboration non comme un objectif mais comme le résultat d’un système bien conçu, vous ne vous contenterez pas de briser un mur : vous construirez des ponts durables pour l’avenir de votre entreprise. L’étape suivante consiste à évaluer où se situent les plus grandes frictions dans votre organisation et à identifier le premier pilier à renforcer pour initier ce cercle vertueux.