Penser que l’IA est une solution magique est la première erreur ; sa véritable puissance ne se libère que lorsqu’on la traite comme une science exacte, contrôlée et mesurable.

- Le succès d’un modèle prédictif dépend à 80% de la qualité et du nettoyage des données historiques, en éliminant les « biais silencieux ».

- Exiger l’explicabilité des algorithmes (« boîte de verre ») n’est pas une option : c’est une condition sine qua non pour la confiance, la conformité et l’amélioration continue.

Recommandation : Auditez la robustesse de votre infrastructure de données (Data Warehouse, Data Catalog) avant même d’envisager le déploiement d’un outil d’IA.

Un stock de best-sellers qui dort sur une étagère. Un client fidèle qui part sans explication. Un camion de livraison qui effectue une tournée suboptimale. Pour un directeur Supply Chain ou Commercial, ces scénarios ne sont pas des abstractions, mais des pertes sèches et des sources de frustration quotidiennes. Face à cette complexité, la promesse de l’Intelligence Artificielle et de ses algorithmes prédictifs semble être la solution miracle : une technologie capable de voir l’avenir et de prendre des décisions parfaites.

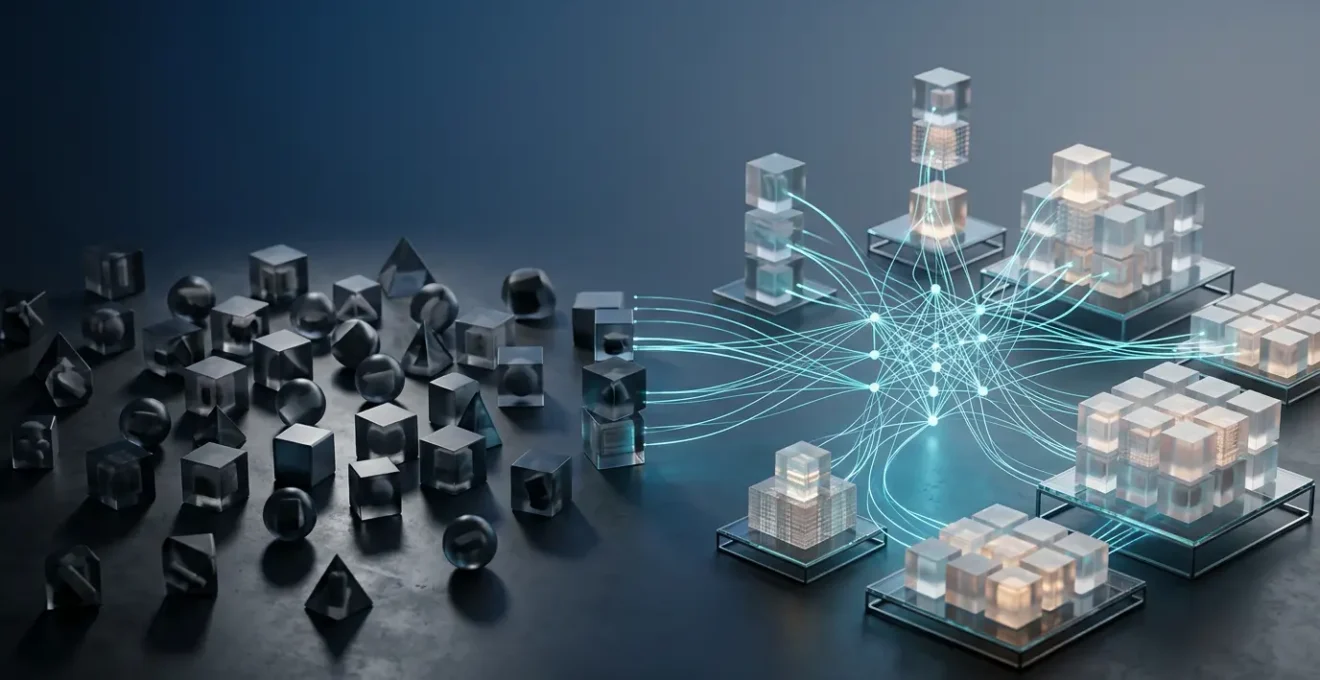

Pourtant, cette vision relève plus du marketing que de la réalité opérationnelle. L’erreur fondamentale est de considérer l’IA comme une boîte noire magique. En réalité, un algorithme prédictif n’est qu’un outil mathématique sophistiqué. Sa performance ne dépend pas d’une quelconque intelligence mystérieuse, mais de la maîtrise rigoureuse de trois piliers fondamentaux : la qualité absolue des données qui le nourrissent, la transparence de ses mécanismes de décision (son « explicabilité ») et la robustesse de l’infrastructure technique qui le supporte.

L’enjeu pour un décideur n’est donc pas d’acheter le dernier logiciel à la mode, mais de développer une culture de la donnée qui transforme cette « boîte noire » en une « boîte de verre » : un levier de performance puissant, car il est compris, mesurable et contrôlé. Il s’agit de passer d’une confiance aveugle à un pilotage éclairé, où chaque prédiction peut être tracée, chaque décision justifiée et chaque résultat amélioré de manière itérative.

Cet article n’est pas une énième ode aux possibilités de l’IA. C’est un guide opérationnel qui décortique, à travers huit cas d’usages concrets, les mécanismes, les prérequis et les écueils à éviter pour transformer la promesse de l’analyse prédictive en une réalité profitable pour votre entreprise. Nous allons explorer comment appliquer une rigueur mathématique et business à chaque étape du processus.

Sommaire : Maîtriser l’IA prédictive en 8 cas d’usages opérationnels

- Forecasting : comment nettoyer l’historique de ventes pour ne pas biaiser l’algorithme ?

- Scoring client : comment identifier les clients qui vont partir avant qu’ils ne le fassent ?

- Moteurs de recommandation : comment proposer le bon produit au bon moment (Cross-selling) ?

- Recherche opérationnelle : comment réduire les kilomètres de vos livreurs de 15% ?

- Data Warehouse : pourquoi ne jamais brancher votre outil BI directement sur la base de production ?

- Data Quality : comment détecter et corriger les doublons et les formats erronés ?

- Explicabilité de l’IA : pourquoi devez-vous comprendre comment l’algorithme a pris sa décision ?

- Data Catalog : comment éviter que votre lac de données (Data Lake) ne devienne un marécage (Data Swamp) ?

Forecasting : comment nettoyer l’historique de ventes pour ne pas biaiser l’algorithme ?

La prévision des ventes est la pierre angulaire de toute stratégie de stock. L’approche classique consiste à appliquer des moyennes mobiles sur les ventes passées. Cependant, cette méthode est aveugle aux « biais silencieux » qui polluent l’historique : une promotion exceptionnelle qui a gonflé artificiellement les ventes de mars, une rupture de stock sur un produit phare en août qui a sous-évalué sa demande réelle, ou encore l’impact d’un événement externe non récurrent. Nourrir un algorithme avec ces données brutes, c’est garantir une prédiction erronée.

L’IA de forecasting moderne ne se contente pas de calculer. Sa première tâche est un travail de détective : elle identifie et neutralise ces anomalies. Elle peut, par exemple, détecter un pic de ventes corrélé à une campagne marketing et le « lisser » pour estimer la demande de base. Inversement, elle peut identifier une période de ventes à zéro malgré une demande continue sur des produits similaires et en déduire une rupture de stock, corrigeant ainsi l’historique à la hausse. Ce nettoyage permet de créer une ligne de base de la demande organique, beaucoup plus fiable pour la prédiction.

En automatisant cette analyse fine, l’IA ne fait pas que gagner du temps ; elle change la nature même de la prévision. L’étude de cas d’Idaho Forest Group est éloquente : en utilisant des améliorations basées sur l’IA, l’entreprise a réduit son temps de prévision de plus de 80 heures à moins de 15 heures. Plus important encore, la précision s’en trouve décuplée. Il n’est pas rare de voir des entreprises réduire leurs erreurs de prévision de plus de 50% après la mise en place d’une IA capable de retraiter intelligemment l’historique.

Scoring client : comment identifier les clients qui vont partir avant qu’ils ne le fassent ?

La perte d’un client (le « churn ») est rarement un événement soudain. C’est un processus graduel, marqué par une série de « signaux faibles » qu’un commercial ou un chargé de compte, submergé par son portefeuille, ne peut pas toujours détecter. Il peut s’agir d’une baisse de la fréquence d’achat, d’une diminution du panier moyen, de la consultation répétée des pages de contact ou de résiliation, d’une moindre réactivité aux emails marketing, ou d’un changement de comportement dans l’utilisation d’un service. Pris isolément, chaque signal est anodin. Agrégés, ils dessinent le portrait d’un client sur le départ.

C’est là que l’IA de scoring client démontre sa supériorité. Un modèle de machine learning peut analyser en continu des centaines de variables comportementales pour chaque client. Il apprend à reconnaître les combinaisons de signaux qui, statistiquement, ont précédé un départ dans le passé. Il ne se contente pas de dire « ce client est à risque », il attribue un score de probabilité de churn (par exemple, « 75% de risque de départ dans les 30 prochains jours ») et, plus important encore, il peut identifier les principaux facteurs contribuant à ce risque (par exemple, « baisse de 20% de la fréquence de connexion » et « ouverture de 3 tickets de support non résolus »).

Cette approche proactive change radicalement la gestion de la relation client. Au lieu de réagir après la perte du client, vous pouvez agir en amont : déclencher une offre personnalisée, un appel d’un commercial, ou une enquête de satisfaction ciblée pour désamorcer le problème avant qu’il ne soit trop tard. C’est passer d’une posture réactive à une stratégie de rétention prédictive et chirurgicale.

Cette image illustre parfaitement la subtilité requise : l’IA excelle à capturer ces micro-gestes de désengagement, ces hésitations invisibles à l’œil nu, pour les transformer en une alerte business actionnable. Il ne s’agit plus d’intuition, mais d’une analyse factuelle et continue du comportement client.

Moteurs de recommandation : comment proposer le bon produit au bon moment (Cross-selling) ?

Le cross-selling traditionnel repose souvent sur des règles métier simples : « les clients qui achètent des pâtes achètent aussi de la sauce tomate ». Si cette approche a son utilité, elle atteint vite ses limites. Les moteurs de recommandation basés sur l’IA transcendent cette logique simpliste en adoptant des approches mathématiques plus complexes, comme le filtrage collaboratif ou l’analyse séquentielle.

Le filtrage collaboratif ne se base pas sur les produits, mais sur les comportements d’utilisateurs similaires. L’algorithme identifie un groupe de clients ayant des goûts et un historique d’achat proches des vôtres. Il vous recommandera alors des produits que ces « jumeaux statistiques » ont aimés, mais que vous n’avez pas encore découverts. L’analyse séquentielle va encore plus loin : elle analyse l’ordre dans lequel les produits sont achetés pour prédire le prochain achat logique. Elle peut ainsi comprendre qu’un client achetant une imprimante est susceptible d’acheter des cartouches non pas immédiatement, mais trois mois plus tard.

L’impact business est direct et mesurable. Il ne s’agit pas seulement d’augmenter le nombre de produits par panier, mais bien la valeur globale de la commande. Selon Salesforce, les acheteurs qui interagissent avec des recommandations personnalisées génèrent des commandes dont la valeur moyenne est supérieure de 26%. C’est la preuve que la pertinence est un levier de rentabilité. Le cas d’Amazon est une référence incontournable du secteur ; on estime qu’environ 30% de son chiffre d’affaires provient directement de son algorithme de recommandation, une machine à anticiper les désirs des consommateurs avant même qu’ils ne les formulent explicitement.

Recherche opérationnelle : comment réduire les kilomètres de vos livreurs de 15% ?

L’optimisation des tournées de livraison est une application directe d’une branche des mathématiques appliquées : la recherche opérationnelle. Le défi est une variation du célèbre « problème du voyageur de commerce » : trouver le chemin le plus court pour visiter un ensemble de points de livraison et revenir au point de départ. Si le problème semble simple avec 5 adresses, il devient exponentiellement complexe avec des centaines de livraisons, des contraintes multiples et des variables dynamiques.

Un planificateur humain, même expérimenté, s’appuie sur des heuristiques et une connaissance du terrain. Il ne peut cependant pas traiter simultanément toutes les contraintes : les fenêtres de livraison spécifiques à chaque client, la capacité de chaque véhicule, les temps de pause obligatoires des chauffeurs, les limitations de circulation selon le type de véhicule, et surtout, les données de trafic en temps réel. Un algorithme d’optimisation, lui, est conçu pour cela. Il modélise le problème comme un système d’équations à résoudre sous contraintes, cherchant la solution qui minimise une fonction de coût (souvent la distance totale ou le temps total).

L’IA apporte une couche supplémentaire en intégrant des données prédictives, comme l’estimation du trafic à différentes heures de la journée. Le résultat est une planification non seulement optimale sur le papier, mais aussi résiliente face aux aléas du réel. Les bénéfices ne sont pas marginaux. Selon le McKinsey Global Institute, les entreprises qui déploient des solutions d’IA pour l’optimisation logistique constatent des économies moyennes de 15 à 20% sur les coûts de transport, principalement grâce à la réduction des kilomètres parcourus, une meilleure utilisation des actifs et une diminution de la consommation de carburant.

Data Warehouse : pourquoi ne jamais brancher votre outil BI directement sur la base de production ?

Dans la quête de la donnée, une erreur fréquente et dangereuse est de connecter les outils d’analyse (Business Intelligence, ou BI) directement sur la base de données de production (votre ERP, votre CRM, etc.). C’est l’équivalent de faire des travaux de rénovation sur une autoroute aux heures de pointe. L’idée de travailler sur la donnée « la plus fraîche possible » est un leurre qui cache trois risques majeurs pour l’entreprise.

La séparation des environnements n’est pas un luxe technique, mais une nécessité stratégique. L’architecture correcte consiste à mettre en place un Data Warehouse (entrepôt de données), une base de données distincte, optimisée pour l’analyse. Les données de production y sont copiées et transformées à intervalles réguliers (par exemple, toutes les nuits). C’est sur cet entrepôt, et uniquement sur lui, que les outils de BI doivent se connecter. Les risques à ne pas le faire sont critiques :

- Ralentissement des performances : Les requêtes analytiques sont lourdes et gourmandes en ressources. Les exécuter sur la base de production ralentit les opérations quotidiennes pour tous les utilisateurs, impactant directement l’expérience des clients et l’efficacité des collaborateurs.

- Risque de corruption des données : Chaque connexion est une porte d’entrée potentielle. Une mauvaise manipulation d’un analyste, une requête mal écrite, pourrait accidentellement modifier, voire supprimer des données de production critiques, avec des conséquences désastreuses.

- Incohérence des indicateurs (KPI) : Sans un Data Warehouse pour centraliser, nettoyer et standardiser les règles de calcul métier, chaque analyste est libre d’interpréter la donnée. Deux services pourraient alors calculer le « chiffre d’affaires » de manière différente, créant le chaos, la méfiance envers les chiffres et l’impossibilité de prendre des décisions éclairées.

L’infrastructure de confiance que représente un Data Warehouse est le socle sur lequel toute stratégie de données sérieuse doit être construite. Il garantit la performance, la sécurité et, surtout, la cohérence. C’est un prérequis non négociable avant même de penser à brancher un algorithme prédictif.

Data Quality : comment détecter et corriger les doublons et les formats erronés ?

Le mantra « Garbage In, Garbage Out » (déchets en entrée, déchets en sortie) est le principe le plus fondamental de la science des données. Un algorithme, aussi sophistiqué soit-il, ne pourra jamais produire de prédictions fiables s’il est nourri avec des données de mauvaise qualité. Selon de nombreux experts, la préparation et le nettoyage des données représentent jusqu’à 80% du travail d’un projet d’analyse prédictive. Ignorer cette étape, c’est se condamner à l’échec.

La mauvaise qualité des données prend de multiples formes. Les plus évidentes sont les doublons (le même client ou produit enregistré plusieurs fois sous des identifiants différents) et les formats erronés (des dates au format américain et européen dans la même colonne, des adresses incomplètes). La détection de ces problèmes passe par des techniques de « profiling » de données, qui analysent la structure, la distribution et la cohérence de chaque champ. La correction, quant à elle, implique des processus de standardisation, de dédoublonnage (souvent via des algorithmes de similarité de chaînes de caractères comme Levenshtein) et d’enrichissement (par exemple, en utilisant des services externes pour valider des adresses postales).

Mais la qualité des données va au-delà de la simple propreté technique. Elle touche aussi à la sémantique. Les données sont-elles complètes ? Sont-elles à jour ? Leur signification est-elle univoque pour toute l’entreprise ? Un statut « en cours » signifie-t-il la même chose pour le service commercial et le service logistique ? La mise en place d’une gouvernance des données, avec des responsables (« data stewards ») et des règles claires, est indispensable pour garantir cette cohérence sémantique sur le long terme.

Votre plan d’action pour l’audit de la qualité des données

- Points de contact : Listez tous les systèmes où la donnée est créée ou modifiée (ERP, CRM, formulaires web, importations manuelles).

- Collecte et inventaire : Pour un jeu de données clé (ex: la base clients), inventoriez les champs critiques (nom, adresse, email) et prélevez des échantillons pour identifier les formats, les valeurs manquantes et les incohérences évidentes.

- Confrontation à la réalité : Comparez les données à la réalité métier. Le format d’un numéro de téléphone est-il cohérent avec les standards nationaux ? Les codes postaux correspondent-ils aux villes ?

- Détection des doublons : Utilisez des outils ou des scripts pour rechercher des doublons non seulement par identifiant unique, mais aussi par combinaisons de champs (ex: même nom et même date de naissance).

- Plan de remédiation : Priorisez les problèmes de qualité par impact business (ex: les emails invalides bloquent les campagnes marketing) et définissez un plan pour corriger les données existantes et empêcher la création de nouvelles erreurs à la source.

Explicabilité de l’IA : pourquoi devez-vous comprendre comment l’algorithme a pris sa décision ?

Un modèle d’IA qui prédit le churn client avec 95% de précision est impressionnant. Mais s’il est une « boîte noire » incapable d’expliquer le « pourquoi » de sa prédiction, sa valeur opérationnelle est quasi nulle. Un commercial ne peut pas appeler un client en lui disant « notre algorithme dit que vous allez partir, mais je ne sais pas pourquoi ». Cette absence de transparence est un frein majeur à l’adoption et à la confiance, et elle expose l’entreprise à des risques importants.

L’explicabilité (XAI, pour Explainable AI) est une discipline qui vise à rendre les modèles d’IA interprétables par un humain. Elle répond à trois besoins critiques. Premièrement, la confiance des utilisateurs : un décideur doit comprendre la logique derrière une recommandation pour l’approuver et la défendre. Deuxièmement, la conformité réglementaire : des régulations comme le RGPD donnent aux individus le droit de comprendre les décisions automatisées prises à leur sujet. Une « boîte noire » est un risque juridique. Troisièmement, l’amélioration du modèle : si un modèle fait une erreur, comprendre pourquoi est la seule façon de le corriger et de le rendre plus performant.

Pour éviter un ‘effet boîte noire’, le décideur doit pouvoir retracer le parcours de la prévision. Le fait qu’une solution garantisse cette traçabilité est un gage de confiance supplémentaire pour ses utilisateurs.

– Optimix Software, Guide sur la prévision de la demande avec l’IA

Des techniques comme LIME (Local Interpretable Model-agnostic Explanations) ou SHAP (SHapley Additive exPlanations) permettent de disséquer une prédiction. Elles peuvent, pour une décision donnée, quantifier la contribution de chaque variable. Par exemple : « Ce client a un score de churn de 82% principalement à cause d’une baisse de 30% de sa fréquence d’achat (contribution de +40%) et de l’absence d’interaction avec la dernière campagne (contribution de +25%) ». Loin d’être un simple gadget, l’explicabilité est devenue une composante clé de la performance. Des recherches montrent qu’un modèle de détection de churn intégrant ces techniques peut atteindre une précision de 96,44%, prouvant que transparence et performance ne sont pas opposées, mais complémentaires.

À retenir

- Priorité à la donnée : La performance d’un algorithme dépend à 80% de la qualité, de la propreté et de la pertinence des données qui le nourrissent. Le nettoyage des « biais silencieux » est un prérequis non négociable.

- Exigence d’explicabilité : Refusez les « boîtes noires ». Un modèle prédictif n’a de valeur que si ses décisions sont traçables et compréhensibles par un humain, pour la confiance, la conformité et l’amélioration.

- Solidité de l’infrastructure : Isolez systématiquement votre environnement analytique (Data Warehouse) de votre environnement de production pour garantir performance, sécurité et cohérence des indicateurs.

Data Catalog : comment éviter que votre lac de données (Data Lake) ne devienne un marécage (Data Swamp) ?

La métaphore du « Data Lake » (lac de données) est séduisante : un grand réservoir où l’on déverse toutes les données brutes de l’entreprise, dans l’attente qu’un Data Scientist vienne y pêcher des pépites. Le risque, c’est que sans gouvernance, ce lac se transforme rapidement en « Data Swamp » (marécage de données) : une masse opaque et inutilisable où personne ne sait ce que les données contiennent, d’où elles viennent, si elles sont fiables ou comment les utiliser.

Le Data Catalog est l’antidote à ce chaos. C’est une sorte d’inventaire intelligent de toutes les données de l’entreprise. Pour chaque jeu de données, il documente les « métadonnées » : sa provenance, sa définition métier, son propriétaire (« data steward »), son niveau de qualité, sa fraîcheur, et qui y a accès. Il agit comme une bibliothèque pour vos données, permettant aux analystes et aux algorithmes de trouver rapidement, de comprendre et de faire confiance à l’information dont ils ont besoin, au lieu de passer 80% de leur temps à cette recherche.

Pour un décideur, exiger la mise en place d’un Data Catalog, c’est investir dans la productivité de ses équipes data et dans la pérennité de ses actifs informationnels. C’est la condition pour capitaliser sur l’ensemble des efforts décrits précédemment. L’exemple de la startup française Autone, qui a levé 17 millions de dollars, illustre la puissance d’une approche intégrée. En analysant 100 millions de points de données par client, sa plateforme, qui repose sur une donnée maîtrisée et cataloguée, revendique des résultats spectaculaires : jusqu’à 55% de réduction des stocks, 80% de ruptures en moins, et une hausse de 30% des ventes. Ces chiffres ne sont atteignables que si la donnée est accessible, fiable et comprise.

Alors que la tendance de fond est claire – Gartner estime que 50% des grandes entreprises auront déployé des solutions d’IA dans leur supply chain d’ici 2026 –, la différence entre le succès et l’échec se jouera sur cette maîtrise de l’infrastructure de données. L’IA n’est que la partie émergée de l’iceberg ; la véritable valeur réside dans les fondations invisibles que sont un Data Warehouse robuste, une Data Quality irréprochable et un Data Catalog exhaustif.

Votre prochaine étape n’est pas d’acheter un outil d’IA, mais d’auditer vos processus et votre infrastructure de données à la lumière de ces principes. Commencez par évaluer la qualité de vos données de ventes historiques : c’est le premier pas, et le plus crucial, vers une véritable intelligence prédictive.