La RPA pour systèmes legacy n’est pas un connecteur magique, mais une discipline d’ingénierie qui consiste à gérer la fragilité inhérente des interfaces utilisateur.

- Le succès ne dépend pas de la vitesse d’automatisation, mais de la conception d’une architecture résiliente (checkpoints, transactions) qui anticipe les échecs.

- Le véritable coût de possession (TCO) inclut la « dette de maintenance RPA » générée par des robots fragiles qui cassent à chaque mise à jour de l’application cible.

Recommandation : Priorisez vos premiers projets sur des applications aux interfaces stables (terminaux verts, applications fixes) et investissez dès le premier jour dans une architecture de gestion d’erreurs robuste.

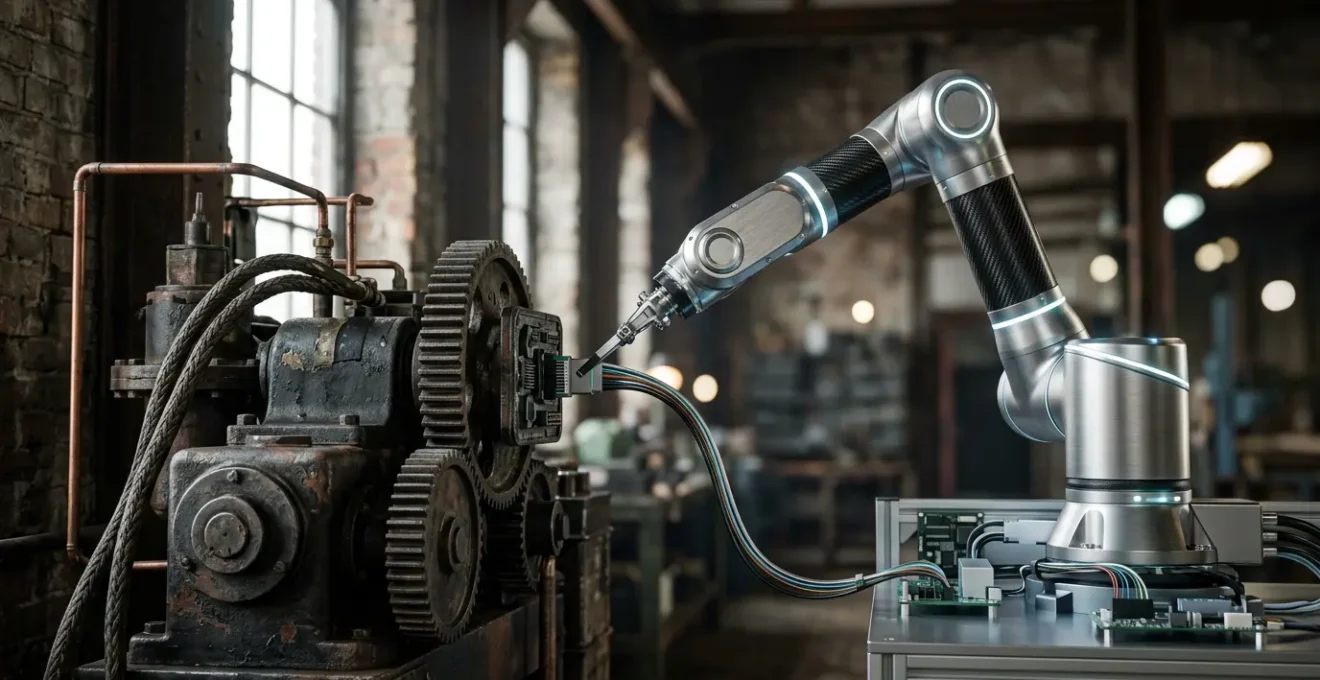

Pour tout DSI ou responsable des opérations, le parc applicatif legacy est une réalité incontournable. Ces systèmes, qu’il s’agisse d’un Mainframe, d’un AS400 ou d’un vieil ERP « maison », sont souvent le cœur battant de l’entreprise. Stables, performants, mais hermétiques : ils n’ont pas d’API. Les moderniser coûte des millions et prend des années. En attendant, les équipes passent des heures sur des tâches manuelles de copier-coller, de saisie et de réconciliation entre ces monolithes et des applications plus modernes. C’est un goulot d’étranglement majeur pour la productivité et une source constante d’erreurs. Selon les dernières données, près de 85 % des grandes entreprises ont déjà implémenté la RPA pour relever ce type de défi.

La promesse de la Robotic Process Automation (RPA) est séduisante : un robot logiciel qui imite les actions d’un humain pour faire le pont, sans une seule ligne de code dans le système source. Là où les solutions habituelles exigent des développements complexes, la RPA semble offrir une connexion « magique ». Cependant, cette magie a un prix, et il se mesure en fragilité. Le robot dépend de l’interface graphique, un socle bien moins stable qu’une API. Un bouton déplacé, une fenêtre qui s’affiche différemment, et le processus casse.

Mais si la véritable clé n’était pas de simplement automatiser, mais de concevoir cette automatisation pour qu’elle survive au monde réel ? L’angle de cet article est pragmatique : nous n’allons pas seulement voir comment connecter vos vieux logiciels, mais comment le faire de manière robuste. Le succès d’un projet RPA sur un système legacy ne réside pas dans la rapidité de développement du robot, mais dans l’ingénierie de la fragilité : la capacité à construire une architecture résiliente qui anticipe, gère et se remet de l’échec inévitable du robot. C’est cette approche qui distingue un « quick win » éphémère d’un véritable levier de productivité à long terme.

Cet article va vous guider à travers les questions critiques que tout responsable doit se poser. Nous aborderons le choix des bons processus, la gestion des pannes, la sécurité des identités robotiques, la rentabilité réelle et les stratégies pour construire des workflows qui durent.

Sommaire : Automatiser les systèmes legacy avec la RPA : une approche pragmatique

- Quelles tâches répétitives sont les meilleures candidates pour une première automatisation RPA ?

- Quand le robot plante : comment gérer la reprise manuelle sans perdre de données ?

- Identité des robots : faut-il donner un mot de passe et un compte AD à un logiciel ?

- Changement d’interface : pourquoi une mise à jour de l’appli cible peut casser tous vos robots ?

- Coût licence vs Temps gagné : le RPA est-il toujours rentable pour les petits volumes ?

- Que faire quand le workflow automatique plante à cause d’un cas particulier ?

- Upload de pièces justificatives : comment vérifier automatiquement la lisibilité des scans reçus ?

- Comment automatiser les workflows administratifs pour gagner 5 heures par semaine ?

Quelles tâches répétitives sont les meilleures candidates pour une première automatisation RPA ?

La première étape de tout projet RPA consiste à identifier les bons cas d’usage. L’erreur commune est de se focaliser uniquement sur le volume et la répétition. Pour un DSI, le critère le plus important, surtout avec des systèmes legacy, est la stabilité du processus et de l’interface. Une tâche très répétitive sur une application web qui change toutes les deux semaines est un piège à maintenance. À l’inverse, une tâche à fréquence modérée sur un émulateur de terminal AS400 (un « écran vert ») est une candidate idéale, car son interface n’a probablement pas changé depuis 10 ans.

Il faut donc prioriser les processus qui sont non seulement manuels et basés sur des règles claires, mais aussi ceux qui s’exécutent sur des applications stables. La criticité est un autre facteur : automatiser un processus où une erreur manuelle a un impact financier ou réglementaire élevé offre un retour sur investissement rapide, même si le volume n’est pas colossal. Il s’agit de trouver l’équilibre parfait entre le gain de productivité et la minimisation du risque de « dette de maintenance RPA ».

La distinction entre « Quick Wins » et « Projets Stratégiques » est essentielle pour construire une feuille de route réaliste. Les premiers permettent de démontrer la valeur rapidement avec un risque maîtrisé, tandis que les seconds s’attaquent à des processus plus complexes mais à plus forte valeur ajoutée.

| Critère d’évaluation | Quick Wins (priorité immédiate) | Projets Stratégiques (moyen terme) |

|---|---|---|

| Stabilité de l’interface | Applications en mode texte ou legacy stable | Applications web avec mises à jour régulières |

| Volume vs Fréquence | Haute fréquence, volume modéré | Volume très élevé, fréquence moyenne |

| Complexité du processus | Tâches simples, règles claires | Processus multi-étapes avec décisions |

| Coût d’une erreur manuelle | Moyen (correction rapide possible) | Élevé (impact financier ou réglementaire) |

| Documentabilité | Processus déjà documenté | Workflow hérité nécessitant analyse |

| Délai de mise en œuvre | 2 à 4 semaines | 2 à 6 mois |

| Exemples types | Génération rapport Access quotidien, saisie ERP simple | Clôture comptable ERP, réconciliation multi-systèmes |

Quand le robot plante : comment gérer la reprise manuelle sans perdre de données ?

C’est la question qui hante tout responsable d’opérations : que se passe-t-il si le robot plante au milieu d’un traitement critique ? La réponse ne peut pas être « on recommence tout à la main ». La robustesse d’une automatisation RPA ne se mesure pas à sa capacité à ne jamais échouer, mais à sa capacité à se remettre d’un échec de manière propre et prévisible. Cela passe par la mise en place d’une architecture de gestion d’erreurs dès la conception, bien avant le premier lancement en production.

Le concept clé ici est l’idempotence transactionnelle. Chaque action critique du robot doit être conçue comme une transaction atomique : soit elle réussit complètement, soit elle est entièrement annulée (rollback), ne laissant jamais le système cible dans un état intermédiaire incohérent. Pour y parvenir, on utilise une machine à états (State Machine) qui enregistre la progression du robot à des points de contrôle (checkpoints). Si le robot s’arrête, il ne redémarre pas du début, mais du dernier checkpoint validé, évitant ainsi les doublons et les pertes de données. Une bonne pratique est de concevoir chaque action pour qu’elle puisse être rejouée sans effet de bord, par exemple, en vérifiant si une facture est déjà payée avant de tenter de la payer à nouveau.

Cette approche transforme un plantage chaotique en une exception contrôlée. L’étude de cas suivante montre comment un cabinet a mis en place ces mécanismes pour sécuriser ses processus comptables.

Étude de Cas : Gestion d’erreurs RPA chez une société de gestion d’actifs

Une société de gestion d’actifs a réussi à réduire de manière significative les erreurs comptables et à accélérer la clôture des comptes en automatisant les tâches répétitives. Pour garantir la fiabilité, ils ont mis en place des mécanismes de reprise robustes. Comme le détaille une analyse de cas d’application de la RPA, le système enregistre chaque étape de traitement et permet une reprise manuelle sans perte de données grâce à une architecture de checkpoints. Cette approche a non seulement amélioré la précision et la conformité, mais a aussi renforcé la confiance des équipes dans l’automatisation.

L’architecture de résilience peut être structurée en quatre couches complémentaires :

- Couche 1 – Transactionnalité : Utiliser une logique de commit/rollback. Le robot enregistre un état « début transaction » avant une action critique et ne valide (« commit ») que si toutes les étapes réussissent. En cas d’erreur, un « rollback » annule les actions partielles.

- Couche 2 – State Machine : Créer des checkpoints qui sauvegardent l’étape précise du workflow. En cas de plantage, le robot redémarre à partir du dernier checkpoint validé.

- Couche 3 – File d’attente Human-in-the-Loop : En cas d’exception, le robot ne crashe pas. Il capture le contexte (ID du cas, données, screenshot) et le place dans une file d’attente pour une intervention humaine.

- Couche 4 – Principe d’idempotence : Concevoir chaque action pour qu’elle puisse être relancée plusieurs fois sans créer de doublons ou d’erreurs.

Identité des robots : faut-il donner un mot de passe et un compte AD à un logiciel ?

La réponse est un oui catégorique, mais encadré par des règles de sécurité strictes. Un robot RPA qui interagit avec vos systèmes legacy est un « travailleur numérique ». À ce titre, il doit posséder sa propre identité non-humaine, avec un identifiant et un mot de passe uniques, tracés et audités. Utiliser un compte utilisateur partagé ou, pire, coder en dur les identifiants dans le script du robot, sont des pratiques à proscrire absolument. Elles créent des failles de sécurité béantes et rendent impossible toute traçabilité en cas d’incident.

La gestion des identifiants des robots doit être traitée avec le même niveau d’exigence que celle des utilisateurs humains. La meilleure pratique consiste à utiliser un coffre-fort numérique (credential vault), souvent intégré à l’orchestrateur RPA (UiPath, Blue Prism, Automation Anywhere). Ce système stocke les mots de passe de manière chiffrée et les fournit au robot uniquement au moment de l’exécution. Le robot n’a jamais connaissance du mot de passe en clair.

Pour les environnements à haute sécurité ou soumis à des régulations strictes (SOX, RGPD), l’intégration avec une solution de Privileged Access Management (PAM) d’entreprise comme CyberArk est l’étalon-or. Cela centralise la gestion des secrets, permet la rotation automatique des mots de passe et offre une auditabilité complète. Comme le souligne une source d’autorité en la matière, le principe directeur doit toujours être la restriction maximale des droits.

Les bots RPA doivent avoir accès uniquement aux applications et fonctionnalités strictement nécessaires à leur tâche, suivant le principe du moindre privilège.

– SAP, Documentation officielle SAP sur l’automatisation robotisée des processus

Le choix de la méthode de gestion des identifiants a un impact direct sur la sécurité, la conformité et la complexité de la mise en œuvre. Le tableau suivant compare les approches courantes.

| Méthode | Niveau de sécurité | Facilité de mise en œuvre | Auditabilité | Recommandation |

|---|---|---|---|---|

| Hardcoding des identifiants | Très faible (credentials en clair dans le code) | Très facile | Nulle | À proscrire absolument |

| Coffre-fort orchestrateur RPA | Bonne (chiffrement, rotation automatique) | Facile (natif dans UiPath, AA, Blue Prism) | Moyenne (logs intégrés) | Bonne pratique standard |

| PAM d’entreprise (CyberArk, etc.) | Excellente (chiffrement, MFA, rotation centralisée) | Complexe (intégration SI) | Excellente (conformité SOX, RGPD) | Étalon-or pour grandes entreprises |

| Compte utilisateur partagé | Faible (traçabilité impossible) | Très facile | Nulle (impossible de distinguer humain/robot) | À éviter (non-conformité) |

Changement d’interface : pourquoi une mise à jour de l’appli cible peut casser tous vos robots ?

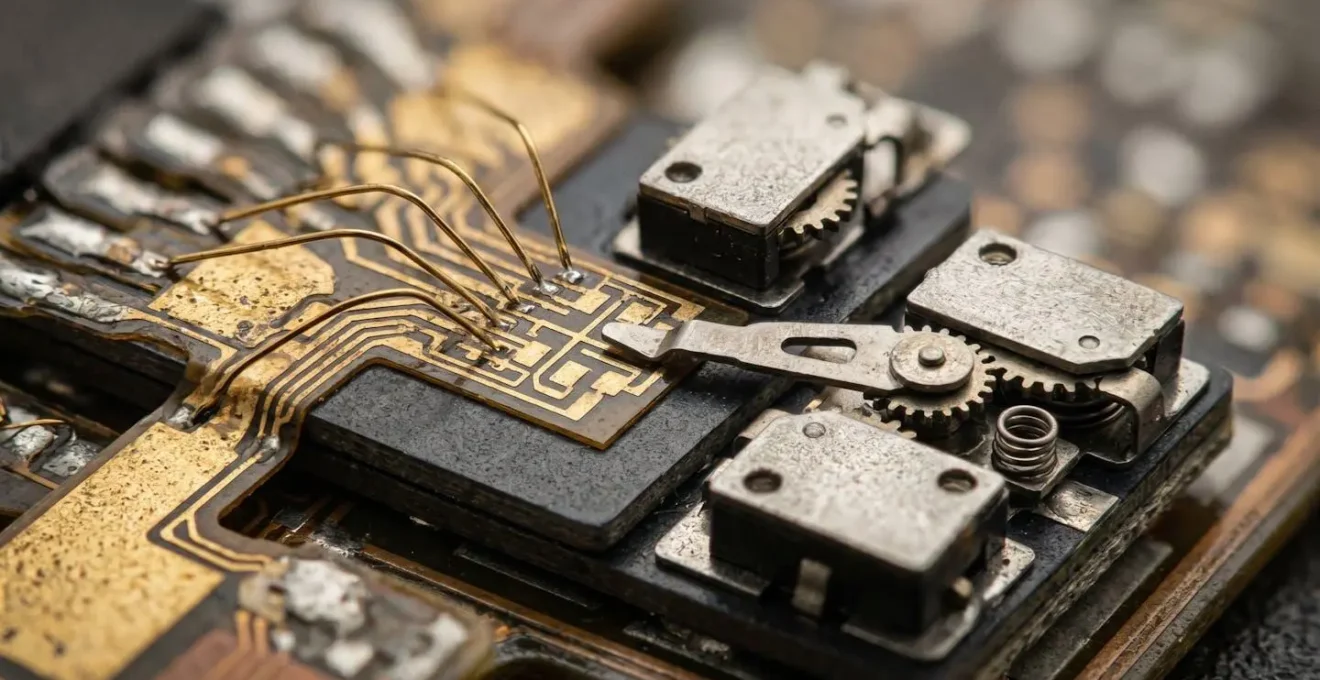

C’est le talon d’Achille de la RPA « classique » et la principale source de la « dette de maintenance ». Contrairement à une API qui est un contrat stable, un robot RPA s’appuie sur des « sélecteurs » pour identifier les éléments de l’interface utilisateur (un bouton, un champ de saisie, une case à cocher). Ces sélecteurs sont souvent basés sur des attributs fragiles comme la position à l’écran (`position:absolute`) ou l’ordre des éléments dans le code (`div[3]/span[2]`). La moindre mise à jour de l’application cible, même un simple changement cosmétique, peut modifier ces attributs et rendre le sélecteur invalide. Le robot devient aveugle : il ne trouve plus le bouton sur lequel il doit cliquer, et le processus plante.

Anticiper cette fragilité est le cœur de l’ingénierie de la résilience en RPA. Il ne s’agit pas d’empêcher les applications de changer, mais de construire des robots qui y résistent. Cela passe par une stratégie de « défense en profondeur » qui combine plusieurs techniques de sélection. Plutôt que de se fier à un seul attribut, on crée des sélecteurs composites qui utilisent des ancres plus stables, comme un `ID` unique, un `aria-label` d’accessibilité, ou des relations relatives (« le champ de saisie à gauche du libellé ‘Nom' »).

Lorsque les sélecteurs traditionnels ne suffisent pas, notamment sur des applications plus anciennes ou en Citrix, les technologies de Computer Vision prennent le relais. Le robot utilise alors la reconnaissance d’image (OCR et pattern matching) pour « voir » l’écran comme un humain, identifiant un libellé ou un bouton par son apparence visuelle plutôt que par sa structure de code. Cette approche, combinée à une gestion d’exception qui notifie l’équipe de maintenance en cas d’échec, permet de construire des automatisations beaucoup plus robustes.

Plan d’action : bâtir une stratégie de défense pour la robustesse des robots

- Sélecteurs intelligents : Prioriser l’utilisation de sélecteurs basés sur des attributs stables (ID, nom unique, `aria-label`) et des logiques floues, plutôt que sur des positions CSS ou des chemins XPath fragiles.

- Ancrage relatif : Définir des sélecteurs par rapport à un élément « ancre » stable. Par exemple : « clique sur le bouton ‘OK’ qui se trouve à droite du champ ‘Code Postal' ».

- Fallback par Computer Vision : En cas d’échec du sélecteur principal, prévoir une seconde tentative basée sur la reconnaissance d’image (OCR) comme mécanisme de secours automatique.

- Exception contrôlée et alerte : Si toutes les tentatives échouent, le robot ne doit pas crasher. Il doit déclencher une exception qui capture le contexte (screenshot, étape du processus), place le cas dans une file d’attente pour analyse humaine et notifie l’équipe de maintenance.

- Gouvernance des changements : Intégrer l’équipe RPA dans le processus de gestion des changements du SI pour anticiper les mises à jour des applications cibles et adapter les robots de manière proactive.

Coût licence vs Temps gagné : le RPA est-il toujours rentable pour les petits volumes ?

Le discours marketing autour de la RPA met souvent en avant des retours sur investissement spectaculaires. Une analyse des déploiements en entreprise montre en effet un ROI moyen de 250% avec un retour sur investissement entre 6 et 9 mois. Cependant, ces chiffres doivent être regardés avec un œil critique. La rentabilité d’un projet RPA ne se résume pas à « temps de traitement manuel x coût horaire de l’employé ». Le coût total de possession (TCO) est bien plus complexe et inclut les licences logicielles, le coût de développement, l’infrastructure, et surtout, le coût de la maintenance continue.

Pour des processus à faible volume, les coûts fixes des plateformes RPA « Enterprise » (UiPath, Automation Anywhere, Blue Prism) peuvent rendre le ROI difficile à atteindre. Une licence de robot « attended » ou « unattended » peut coûter plusieurs milliers d’euros par an, sans compter le salaire d’un développeur RPA certifié pour le construire et le maintenir. Si le robot ne traite que 50 transactions par mois, l’économie réalisée sur le temps de travail manuel peut ne pas couvrir ces coûts fixes.

C’est là que les plateformes RPA Low-Code ou intégrées, comme Microsoft Power Automate (inclus dans de nombreuses licences Microsoft 365), deviennent pertinentes. Leur coût de licence est bien plus faible, voire nul, et elles sont conçues pour être utilisées par des « citizen developers » avec moins de compétences techniques. Pour des automatisations simples et des intégrations au sein de l’écosystème Microsoft (Excel, Outlook, SharePoint), elles offrent un seuil de rentabilité bien plus bas. Le choix de la plateforme est donc stratégique et dépend directement du volume, de la complexité et de la criticité du processus à automatiser.

| Critère | Plateforme RPA Enterprise (UiPath, AA, Blue Prism) | RPA Low-Code (Power Automate, Zapier) |

|---|---|---|

| Coût licence annuel/bot | 3 000 – 10 000 USD | 150 – 500 USD (souvent inclus dans suite Microsoft 365) |

| Coût développement | Élevé (nécessite développeur certifié) | Faible (citizen developer possible) |

| Coût maintenance annuel | 15-30% du coût initial | 5-15% du coût initial |

| Infrastructure requise | Serveur dédié ou VM robuste | Cloud (inclus) |

| Seuil de rentabilité (volume) | > 500 transactions/mois ou processus critique | 50-500 transactions/mois, processus simple |

| Délai d’implémentation | 2-6 mois | 2-4 semaines |

| Cas d’usage optimal | Processus complexes multi-systèmes, haute criticité | Automatisations simples, intégration Office 365 |

Que faire quand le workflow automatique plante à cause d’un cas particulier ?

Toutes les erreurs de robot ne sont pas techniques. Souvent, le robot fonctionne parfaitement, mais il rencontre une exception métier : une situation non prévue dans les règles initiales. Par exemple, un robot traitant des factures est programmé pour des taux de TVA à 20% et 5,5%. Que fait-il s’il reçoit une facture avec une TVA à 0% pour une exportation ? S’il n’a pas été conçu pour cela, il plantera.

La solution n’est pas de tenter de prévoir 100% des cas en amont, ce qui est impossible. La solution est architecturale : le design pattern Human-in-the-Loop (HiTL). Au lieu de considérer l’exception comme un échec, le robot la traite comme un événement normal. Il met le cas en pause, capture tout le contexte nécessaire à la décision (la facture, les données extraites, la raison de l’exception) et le place dans une file d’attente à destination d’un opérateur humain. L’humain intervient alors via une interface simple pour valider, refuser ou corriger le cas. Le processus global n’est jamais interrompu.

L’approche HiTL transforme les exceptions de problèmes en opportunités. Chaque décision prise par un humain peut être utilisée pour enrichir le jeu de règles du robot. Dans notre exemple, après avoir vu plusieurs factures à 0% validées par des humains, on peut mettre à jour le robot pour qu’il les traite automatiquement. C’est un cercle vertueux d’apprentissage continu qui rend le système de plus en plus autonome et performant avec le temps.

Étude de Cas : Gestion d’exceptions métier avec HiTL dans le secteur bancaire

Une grande banque a mis en place un système RPA pour le traitement des demandes de prêt, intégrant nativement le pattern Human-in-the-Loop. Une étude de cas sur l’utilisation de la RPA en entreprise montre que lorsqu’un cas particulier survient (ex: un demandeur avec un type de contrat de travail non standard), le robot ne plante pas. Il met le dossier en pause et le présente à un opérateur via une interface simple avec des options (‘Valider’, ‘Refuser’, ‘Demander plus d’infos’). Cette approche a permis de créer un système d’apprentissage continu, réduisant le taux d’exceptions nécessitant une intervention humaine de 40% la première année.

Upload de pièces justificatives : comment vérifier automatiquement la lisibilité des scans reçus ?

L’automatisation de la saisie de données à partir de documents (factures, bons de commande, pièces d’identité) est un cas d’usage majeur de la RPA, souvent couplée à des technologies d’Intelligent Document Processing (IDP). Cependant, le succès de ce processus dépend entièrement de la qualité du document en entrée. Un scan flou, de travers ou trop sombre rendra l’extraction par OCR (reconnaissance optique de caractères) impossible ou peu fiable. Rejeter manuellement ces documents ou les saisir à la main annule tout le bénéfice de l’automatisation.

Une approche robuste consiste à mettre en place un « pipeline » de vérifications automatiques en cascade, qui agit comme un contrôle qualité en amont. Ce pipeline évalue chaque document reçu sur plusieurs niveaux avant même de tenter une extraction de données complexe. Le but est de décider instantanément si un document peut être traité automatiquement, s’il nécessite une validation humaine, ou s’il doit être rejeté avec une notification claire à l’expéditeur.

Cette vérification en cascade est essentielle pour garantir un haut niveau de « straight-through processing » (traitement sans intervention humaine). Les meilleures pratiques du domaine de l’IDP utilisent un score de confiance pour aiguiller le workflow : par exemple, un score supérieur à 95% signifie un traitement 100% automatique, un score entre 70 et 95% envoie le document pour validation humaine finale, et un score inférieur à 70% entraîne un rejet automatique. Cette approche métrique permet de piloter la performance du processus et de concentrer l’effort humain là où il a le plus de valeur.

Voici une checklist des vérifications à mettre en place :

- Niveau 1 – Vérifications techniques : Le robot vérifie d’abord les métadonnées de base du fichier : format accepté (PDF, JPG), poids (ni trop lourd, ni trop léger), résolution (minimum 150 DPI pour un OCR efficace).

- Niveau 2 – Test OCR de base : Une extraction OCR rapide est lancée pour s’assurer que le document contient une quantité minimale de texte lisible. Si un PDF ne contient que des images sans texte, il est immédiatement signalé.

- Niveau 3 – Qualité d’image : Des algorithmes analysent l’image pour détecter les problèmes courants : flou, contraste insuffisant, mauvaise orientation, ou zones sombres qui pourraient masquer des informations.

- Niveau 4 – Cohérence métier : Pour les documents passant les premiers filtres, le robot extrait les champs critiques (date, montant, n° de SIREN) et vérifie leur format et leur cohérence (ex: la date de la facture n’est pas dans le futur).

À retenir

- L’automatisation sur systèmes legacy n’est pas un projet IT, mais une discipline d’ingénierie qui doit anticiper la fragilité des interfaces.

- La robustesse d’un robot se mesure à sa capacité à gérer les erreurs (techniques et métier) via une architecture transactionnelle et des workflows Human-in-the-Loop.

- Le vrai ROI de la RPA doit inclure le coût total de possession (TCO), notamment la maintenance, ce qui peut justifier des solutions Low-Code pour les petits volumes.

Comment automatiser les workflows administratifs pour gagner 5 heures par semaine ?

L’objectif final de l’automatisation des processus administratifs est simple : libérer du temps humain pour des tâches à plus haute valeur ajoutée. Le gain de « 5 heures par semaine » par collaborateur n’est pas un mythe, mais le résultat d’une stratégie RPA bien menée, qui va au-delà de la simple réplication de clics. Il s’agit de repenser le workflow dans son ensemble, en identifiant non seulement les tâches répétitives, mais aussi les points d’attente, les goulots d’étranglement et les sources d’erreurs.

Le gain de temps provient de plusieurs sources cumulées. D’abord, l’exécution des tâches elles-mêmes, qu’un robot peut réaliser 24/7, sans pause et sans erreur de saisie. Ensuite, la réduction du temps de correction, car un robot bien conçu génère moins d’erreurs qu’un humain fatigué. Enfin, et c’est souvent le gain le plus important, l’optimisation du flux de travail. En intégrant des mécanismes de Human-in-the-Loop, on élimine les temps morts où un dossier est en attente d’une validation ou d’une correction.

Cependant, ce gain n’est durable que si les principes d’ingénierie de la fragilité que nous avons vus sont appliqués. Un gain de 5 heures peut vite se transformer en 10 heures de maintenance si les robots sont fragiles et cassent constamment. Le véritable levier de productivité réside dans la construction d’un écosystème d’automatisation résilient, où les robots et les humains collaborent de manière fluide, chacun se concentrant sur ce qu’il fait de mieux : l’exécution pour le robot, la décision et la gestion des exceptions pour l’humain.

Étude de Cas : Gain de 5 heures hebdomadaires dans les RH grâce à la RPA

Une grande entreprise a réduit de 50% le temps nécessaire pour traiter les demandes de congé, les remboursements de frais et les processus d’intégration des nouveaux employés. En automatisant ces workflows, les équipes RH ont libéré en moyenne 5 heures par semaine et par collaborateur. Ce temps a été réinvesti dans des activités plus stratégiques comme le recrutement, le développement des compétences et l’amélioration de l’expérience collaborateur. Ce cas montre que la valeur générée va bien au-delà du simple gain de temps initial, à condition que les automatisations soient fiables.

Pour passer de la théorie à la pratique, la première étape consiste à évaluer la stabilité de vos processus cibles et à définir une architecture de gestion d’erreurs adaptée à votre contexte. C’est le véritable point de départ d’une automatisation réussie et pérenne.