La vraie question n’est pas d’éviter la dette technique, mais de choisir consciemment laquelle — technique, de connaissance ou de rigidité — votre organisation peut réellement maîtriser.

- Le développement spécifique crée une dette technique classique, mesurable et remboursable par du refactoring.

- Le paramétrage avancé génère une dette de connaissance et de rigidité, plus insidieuse et difficile à auditer.

Recommandation : Traiter la configuration comme du code (Configuration-as-Code) est l’unique approche durable pour gérer ces deux formes de risque et garantir la maintenabilité.

Pour tout chef de projet technique, le dilemme est quotidien. Un utilisateur exprime un besoin : faut-il activer une option cachée dans les méandres de l’interface d’administration, ou planifier un sprint de développement pour créer une solution sur mesure ? La réponse semble souvent évidente : le paramétrage est rapide et peu coûteux, le développement est long et onéreux. Pourtant, cette vision à court terme est un piège qui hypothèque l’avenir de n’importe quel système d’information. Elle ignore la nature polymorphe de la dette que chaque décision engendre.

L’erreur fondamentale est de croire qu’il existe une option sans dette. Le développement spécifique crée une dette technique tangible, visible dans le code. Le paramétrage à outrance, lui, génère une dette plus sournoise : une dette de connaissance, où la logique métier est disséminée dans des centaines de cases à cocher, et une dette de rigidité, où le système devient si personnalisé qu’il est impossible à mettre à jour. La question n’est donc pas « comment éviter la dette ? », mais bien « quel type de dette sommes-nous prêts à gérer et à rembourser ? ».

Cet article propose de changer de paradigme. Au lieu d’opposer configuration et code, nous allons les analyser comme deux formes d’un même arbitrage de risque. En comprenant la nature de la dette créée par chaque approche, un chef de projet peut prendre des décisions éclairées, non pas pour éliminer la dette — une illusion — mais pour la choisir, la maîtriser et assurer la pérennité du logiciel.

Pour vous guider dans cet arbitrage stratégique, nous allons explorer les différentes facettes du risque associé à chaque choix, depuis l’expérience utilisateur jusqu’à la maintenabilité à long terme, afin de vous donner les clés pour placer le curseur au bon endroit.

Sommaire : Naviguer entre paramétrage et développement : un guide pour maîtriser la dette technique

- Sur-configuration : pourquoi trop d’options de paramétrage tuent l’expérience utilisateur ?

- Dev, Test, Prod : comment transporter vos paramétrages d’un environnement à l’autre sans erreur ?

- Dette de connaissance : que se passe-t-il quand l’expert du paramétrage quitte l’entreprise ?

- Qui peut toucher aux réglages ? L’importance de restreindre l’accès au paramétrage avancé

- Mises à jour logicielles : vos paramétrages customisés vont-ils sauter à la prochaine version ?

- Monolithe vs Microservices : la complexité en vaut-elle la chandelle pour votre taille d’équipe ?

- Refactoring : quand faut-il arrêter de développer des features pour nettoyer le code existant ?

- Clean Code et Software Craftsmanship : pourquoi la qualité du code est un investissement rentable ?

Sur-configuration : pourquoi trop d’options de paramétrage tuent l’expérience utilisateur ?

L’intention initiale du paramétrage est louable : offrir de la flexibilité. Cependant, poussée à l’extrême, cette flexibilité se transforme en un fardeau cognitif pour les utilisateurs et les administrateurs. Un logiciel avec des centaines d’options de configuration devient un labyrinthe où la moindre modification peut avoir des conséquences imprévues. Cette complexité accidentelle n’apporte aucune valeur métier ; au contraire, elle ralentit les opérations et augmente le risque d’erreurs humaines. Chaque option est une micro-décision que l’utilisateur doit prendre, ce qui conduit à une paralysie de l’analyse et à une frustration croissante.

Cette prolifération d’options est une forme insidieuse de dette technique. Alors que la dette de code se manifeste par un algorithme lent, la dette de configuration se traduit par une interface utilisateur incompréhensible et une logique métier éclatée. Le coût n’est pas seulement humain ; il est aussi financier. Selon une analyse d’experts, la dette technique mobilise en moyenne 30% des budgets IT des entreprises, et une part non négligeable de ce chiffre provient de la maintenance et du support liés à des systèmes sur-configurés.

Le bon arbitrage ne consiste pas à supprimer toutes les options, mais à appliquer le principe de « convention plutôt que configuration ». Le logiciel doit proposer un fonctionnement par défaut sensé et éprouvé, qui couvre 80% des cas d’usage. Le paramétrage avancé doit rester l’exception, réservé à des besoins spécifiques et documentés, et non la norme pour chaque fonctionnalité.

Dev, Test, Prod : comment transporter vos paramétrages d’un environnement à l’autre sans erreur ?

L’un des risques les plus concrets du paramétrage manuel réside dans le déploiement. Lorsqu’un administrateur configure une nouvelle fonctionnalité sur l’environnement de test en cochant vingt cases et en modifiant dix listes déroulantes, comment garantir que cette configuration sera reproduite à l’identique en production ? Le processus manuel est une source inépuisable d’erreurs : un oubli, une mauvaise valeur, une option mal interprétée. Ces « bugs de déploiement » sont coûteux, stressants et totalement évitables.

La solution à cet arbitrage de risque est de traiter la configuration non pas comme une série de clics, mais comme du code. C’est le principe du Configuration-as-Code (CaC). Au lieu de modifier les paramètres via une interface graphique, on les décrit dans des fichiers textes (YAML, JSON, etc.) qui sont ensuite stockés, versionnés et audités dans un système de contrôle de version comme Git. Ces fichiers deviennent la seule source de vérité pour la configuration du logiciel.

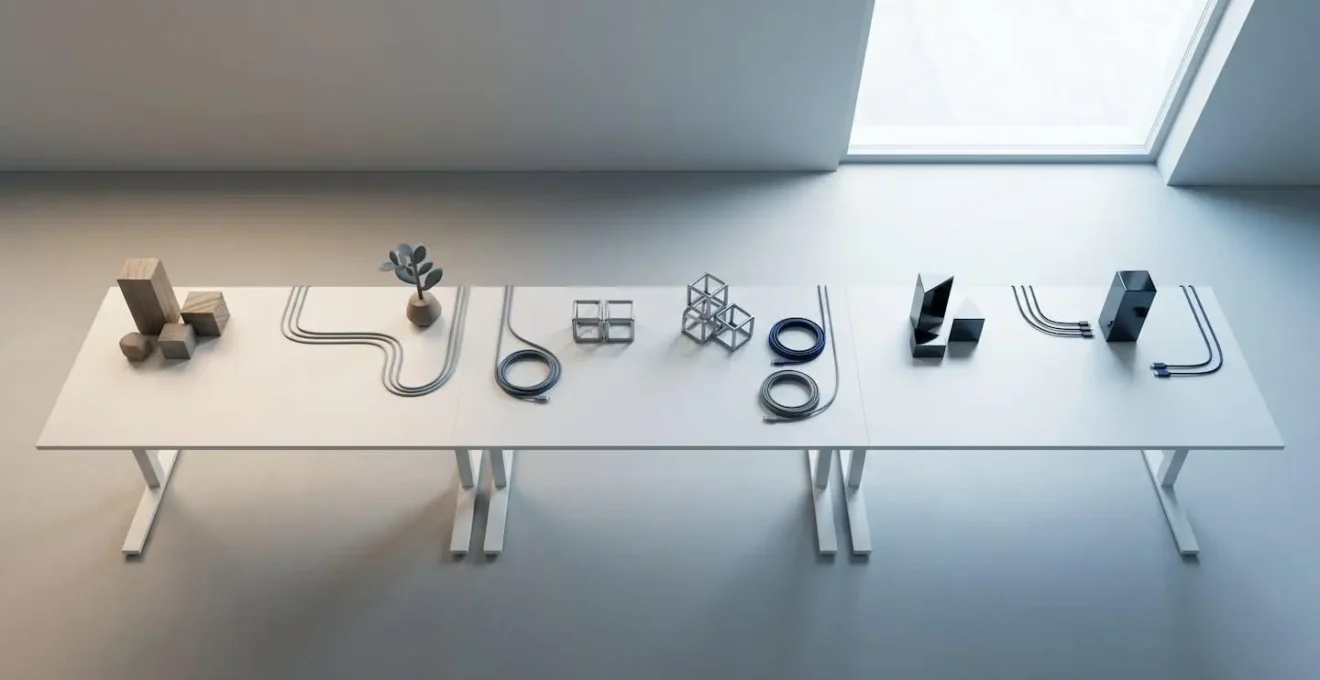

Comme le montre ce schéma de principe, le flux devient maîtrisé. La configuration est développée et testée sur une branche, puis fusionnée et déployée automatiquement sur les différents environnements. Cette approche transforme la gestion des paramétrages. Selon une analyse de CloudBees, le modèle Configuration as Code élimine les migrations manuelles en traitant les configurations comme du code versionné, permettant de tester et de valider les changements dans chaque environnement avant de les appliquer en production, ce qui fiabilise l’ensemble du processus.

Dette de connaissance : que se passe-t-il quand l’expert du paramétrage quitte l’entreprise ?

Le développement spécifique, même complexe, laisse une trace : le code. Avec les bons outils et un peu de temps, une nouvelle équipe peut l’analyser. Le paramétrage avancé, lui, crée un risque beaucoup plus volatile : la dette de connaissance. Cette dette s’accumule lorsqu’une seule personne, souvent un « super-administrateur », devient le dépositaire unique de la logique métier du logiciel. C’est elle qui sait pourquoi telle case est cochée, pourquoi telle valeur est fixée à « 42 » et quelles sont les cinq options à modifier en cascade pour activer une nouvelle grille tarifaire.

Le jour où cet expert quitte l’entreprise, le savoir s’évapore avec lui. Le logiciel devient une boîte noire. Personne n’ose plus toucher aux réglages de peur de tout casser. L’entreprise est paralysée, incapable de faire évoluer son propre outil. Ce n’est pas un problème technique, mais un risque organisationnel majeur. Comme le souligne Junade Ali dans ses écrits sur la dette technique, un logiciel mal conçu génère un stress accru et un taux de rotation du personnel plus élevé, créant un cercle vicieux où la perte de connaissance accélère la dégradation du système.

Cette situation est le symptôme d’une configuration qui a été utilisée pour coder de la logique métier complexe. Pour mitiger ce risque, la réponse est double :

- Documentation systématique : Chaque paramètre non standard doit être justifié par une documentation qui explique son « pourquoi ».

- Configuration-as-Code (CaC) : En externalisant la configuration dans des fichiers versionnés, la logique devient lisible, auditable et commentée, comme du vrai code. La connaissance n’est plus dans la tête d’une personne, mais dans le dépôt Git.

Qui peut toucher aux réglages ? L’importance de restreindre l’accès au paramétrage avancé

La question de l’accès au paramétrage est un arbitrage critique entre agilité et sécurité. Donner un accès large peut sembler efficace à court terme — les équipes sont autonomes pour adapter l’outil à leurs besoins. Cependant, sans une gouvernance claire, c’est la porte ouverte au chaos. Des modifications incohérentes, des tests de sécurité désactivés pour « faciliter un test », ou des configurations critiques altérées par inadvertance peuvent avoir des conséquences désastreuses.

Le principe du moindre privilège doit s’appliquer avec la même rigueur au paramétrage qu’à la gestion des droits d’accès système. L’accès aux réglages avancés ne doit pas être un droit, mais une capacité accordée de manière contrôlée et limitée dans le temps. Un chef de projet prudent doit définir une matrice de responsabilités claire : qui peut demander un changement, qui peut le valider, et surtout, qui est techniquement habilité à l’appliquer.

Restreindre l’accès ne signifie pas créer un goulot d’étranglement. Cela signifie mettre en place un processus formel, idéalement soutenu par des outils. Le Configuration-as-Code est une fois de plus un allié précieux : les demandes de changement se matérialisent par des « pull requests » ou « merge requests », qui peuvent être revues, commentées et validées par les parties prenantes avant d’être appliquées automatiquement. La gouvernance est ainsi intégrée au flux de travail technique.

Votre plan d’action pour une gouvernance de configuration robuste

- Versionnement : La configuration doit être stockée et versionnée dans un système de contrôle de version (ex: Git) pour garantir traçabilité et réversibilité.

- Accès restreint : L’accès en écriture au dépôt de configuration et aux environnements de production doit être strictement limité aux personnes habilitées et aux pipelines automatisés.

- Gestion des secrets : Les informations sensibles (clés d’API, mots de passe) doivent être chiffrées et stockées séparément du code applicatif et de la configuration non sensible.

- Portes d’approbation : Mettre en place des mécanismes d’approbation (ex: revue de code obligatoire) pour toute modification touchant des paramètres critiques ou des environnements de production.

- Piste d’audit : Assurer l’existence d’un journal d’audit immuable qui trace chaque changement : qui a modifié quoi, quand, et pour quelle raison (via les messages de commit).

Mises à jour logicielles : vos paramétrages customisés vont-ils sauter à la prochaine version ?

C’est la crainte de tout responsable d’application après des années de personnalisation minutieuse : la mise à jour majeure de l’éditeur. Chaque paramètre, chaque script, chaque contournement intelligent représente un point de friction potentiel avec la nouvelle version. Cette fragilité de la personnalisation est une forme de dette qui se révèle brutalement lors des migrations. Si le logiciel a été trop dévié de son standard, la mise à jour peut devenir un projet de refonte complet, coûtant parfois plus cher que l’achat d’une nouvelle licence.

Le risque est particulièrement élevé lorsque le paramétrage n’est pas considéré comme un contrat formel par l’éditeur. Des options peuvent disparaître, être renommées ou changer de comportement sans préavis. Le développement spécifique, s’il est bien isolé et s’appuie sur des API publiques et versionnées, peut paradoxalement s’avérer plus résilient sur le long terme.

Pour un architecte solution, l’analyse de risque doit porter sur la nature du contrat de compatibilité. Il est crucial d’évaluer la maturité de l’éditeur sur ce point. Une approche DevOps moderne, telle que décrite par des acteurs comme CircleCI, traite l’API de configuration comme un contrat versionné. Cela implique des pratiques de dépréciation progressive : les changements cassants (« breaking changes ») sont annoncés plusieurs versions à l’avance, des scripts de migration sont fournis, et un mode de validation « à blanc » (dry-run) permet de tester la nouvelle configuration avant son application. Choisir un logiciel dont l’éditeur adopte cette discipline est une assurance majeure contre l’obsolescence de vos personnalisations.

Monolithe vs Microservices : la complexité en vaut-elle la chandelle pour votre taille d’équipe ?

Le débat entre architecture monolithique et microservices est souvent présenté comme une opposition technique, alors qu’il s’agit avant tout d’un arbitrage de complexité organisationnelle. Adopter une architecture microservices n’est pas un simple choix technique ; c’est importer une complexité distribuée (réseau, déploiement, monitoring, résilience) qui doit être gérée par l’équipe de développement. Pour une grande entreprise avec des équipes dédiées à l’infrastructure (DevOps, SRE), cette complexité est un investissement qui permet l’autonomie des équipes et la scalabilité. Mais pour une petite équipe, cela peut rapidement devenir un fardeau.

Comme le souligne un expert du domaine, « imposer une architecture microservices à une petite équipe de cinq personnes est une recette pour l’épuisement. Les développeurs passeront plus de temps à gérer l’infrastructure qu’à créer de la valeur ». Le choix architectural doit être directement corrélé à la taille et à la maturité de l’équipe. Un monolithe bien structuré (parfois appelé « monolithe modulaire ») est souvent une option bien plus pragmatique et moins coûteuse en dette opérationnelle pour une équipe de taille réduite.

L’exemple le plus frappant de cet arbitrage est sans doute celui de l’équipe Prime Video d’Amazon. Dans un cas d’étude interne, ils ont révélé que le retour d’une architecture microservices à une architecture monolithique pour un de leurs outils a permis de réduire les coûts d’infrastructure de plus de 90%. Ils ont réalisé que la complexité distribuée n’apportait aucun bénéfice tangible pour leur cas d’usage spécifique, illustrant parfaitement que le choix doit être guidé par le contexte, et non par la tendance.

Refactoring : quand faut-il arrêter de développer des features pour nettoyer le code existant ?

Le refactoring est souvent perçu par le métier comme du temps « non productif » car il ne produit aucune nouvelle fonctionnalité visible. C’est une erreur de jugement fondamentale. Le refactoring n’est pas un coût, c’est le remboursement de la dette technique. Ignorer ce remboursement, c’est accepter que les « intérêts » de la dette (ralentissement des développements, augmentation des bugs, difficulté à intégrer de nouveaux développeurs) ne fassent que croître, jusqu’à paralyser complètement le projet.

Le moment où il faut arrêter de développer pour nettoyer est précisément quand la vitesse de développement de nouvelles fonctionnalités commence à chuter drastiquement. C’est le signal que la complexité du code existant est devenue un frein majeur. Selon une étude, plus de 50% des entreprises admettent que la dette technique absorbe plus d’un quart de leur budget informatique. Attendre que la situation soit critique est la pire des stratégies.

Une approche plus saine et durable consiste à intégrer le remboursement de la dette dans le flux de travail normal. Plusieurs stratégies pragmatiques existent :

- La règle des 20% : Allouer systématiquement une partie de chaque sprint (par exemple, 20% du temps) à des tâches de refactoring et d’amélioration de la qualité.

- La règle du Boy Scout : Laisser le code dans un meilleur état que celui dans lequel on l’a trouvé. Chaque fois qu’un développeur intervient sur une portion de code, il doit en profiter pour la nettoyer, même un peu.

- Le refactoring opportuniste : Avant de développer une nouvelle fonctionnalité complexe, prendre le temps de nettoyer et de clarifier la zone du code qui sera impactée. Cela facilite le nouveau développement et réduit le risque de bugs.

Le rôle du chef de projet technique est de rendre ce travail visible et de le défendre auprès du métier, en l’expliquant non pas comme une lubie de développeur, mais comme un investissement essentiel pour maintenir la capacité du projet à évoluer.

À retenir

- Le choix n’est pas entre « dette » et « pas de dette », mais entre une dette technique visible (code) et une dette de connaissance et de rigidité invisible (paramétrage).

- La seule stratégie viable pour gérer le risque du paramétrage est de le traiter comme du code via une approche Configuration-as-Code (CaC), qui garantit la traçabilité, la reproductibilité et la gouvernance.

- La qualité intrinsèque du code (Clean Code) n’est pas un luxe, mais un investissement fondamental qui conditionne la vélocité future et le coût total de possession (TCO) du logiciel.

Clean Code et Software Craftsmanship : pourquoi la qualité du code est un investissement rentable ?

À la fin de tous les arbitrages, un principe demeure non négociable : la qualité intrinsèque du code. Que l’on choisisse le développement spécifique ou que l’on construise un système autour d’un noyau paramétrable, le code sous-jacent est le fondement sur lequel tout repose. Un code de mauvaise qualité, ou « dirty code », est une taxe invisible sur chaque action future. Chaque bug corrigé, chaque fonctionnalité ajoutée, chaque mise à jour de sécurité prendra plus de temps et coûtera plus cher.

Le mouvement du Software Craftsmanship et les principes du Clean Code, popularisés par des figures comme Robert C. Martin, ne sont pas des concepts académiques. Ce sont des pratiques économiques pragmatiques. Un code propre est un code facile à lire, à comprendre et donc à modifier en toute sécurité. Comme le dit l’adage, les développeurs passent dix fois plus de temps à lire du code qu’à en écrire. Investir dans la clarté, c’est donc investir directement dans la productivité de l’équipe. Une étude Stripe de 2018 révélait que les développeurs passent en moyenne plus de 17 heures par semaine sur la maintenance et la gestion de la dette technique.

Les développeurs passent environ dix fois plus de temps à lire du code qu’à en écrire. Le Clean Code améliore donc considérablement la productivité et la qualité logicielle sur le long terme.

– Robert C. Martin (Uncle Bob), Clean Code: A Handbook of Agile Software Craftsmanship

Le coût de l’inaction est astronomique. Le Consortium for Information and Software Quality (CISQ) a estimé le coût de la mauvaise qualité logicielle à 2 080 milliards de dollars rien qu’aux États-Unis en 2020. En tant qu’architecte solution, faire le compromis sur la qualité du code, c’est accepter sciemment de construire sur des fondations mouvantes. C’est le pire calcul qui soit, car la dette contractée à ce niveau est la plus difficile et la plus coûteuse à rembourser.

Pour prendre la bonne décision, la prochaine étape consiste à auditer votre dette existante — qu’elle soit technique ou de connaissance — et à définir une stratégie claire pour la maîtriser, en traitant chaque choix non comme une solution miracle, mais comme un arbitrage de risque calculé.